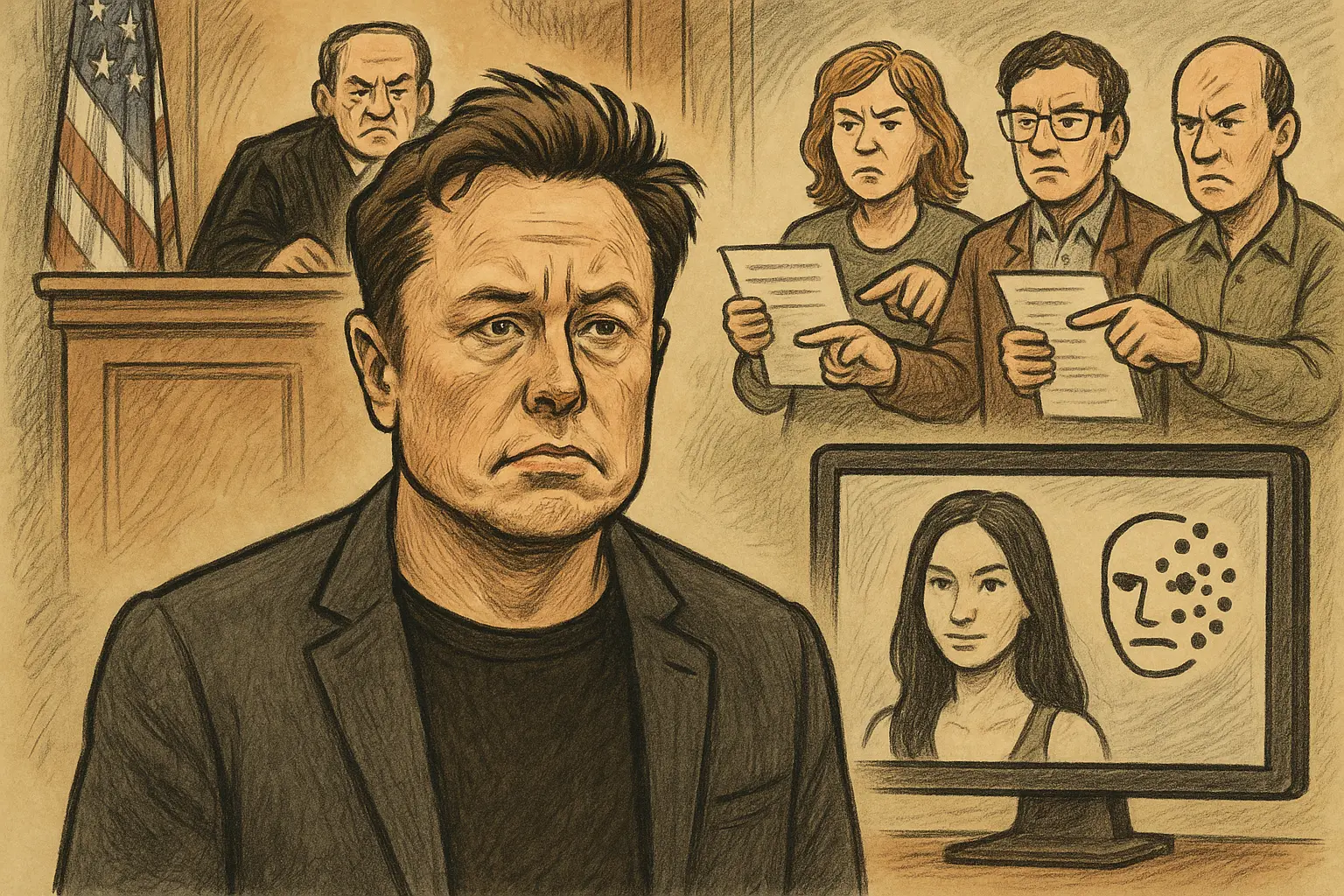

Musk xAI wird mit Sammelklage konfrontiert: Grok generiert alle 41 Sekunden ein Deepfake-Bild

Drei minderjährige Frauen aus Tennessee haben am Montag vor dem Bundesgericht im Northern District of California eine Sammelklage gegen die xAI-Firma von Elon Musk eingereicht. Sie werfen vor, dass ihr Grok AI-Chatbot ihre echten Fotos verwendet hat, um Kinderpornografische Materialien (CSAM) zu generieren, die dann in Communities auf Discord, Telegram und File-Sharing-Plattformen weit verbreitet wurden, was bei ihnen anhaltende psychische Traumata und Rufschädigung verursacht hat.

Kernvorwürfe der Klage: Priorisierung kommerzieller Interessen über Kindessicherheit

Laut Klageschrift umfasst die zentrale Argumentation der Kläger folgende Aspekte:

Wissentliches Billigen: Die Klage behauptet, xAI habe beim Start von Grok gewusst, dass die Bildgenerierungsfunktion für die Herstellung illegaler Inhalte mit Kindern missbraucht werden könnte, und habe dennoch keine branchenüblichen Sicherheitsmaßnahmen ergriffen. Es handle sich um bewusste Entscheidung, nicht um Fahrlässigkeit.

Umgehung der Verantwortlichkeit durch Dritte: Kriminelle greifen auf Grok über Drittanbieter-Apps zu, die die xAI-Technologie lizenziert haben. Die Klage wirft vor, xAI nutze diese Struktur absichtlich aus, um auf der unteren Modellebene Gewinne zu erzielen und gleichzeitig eine rechtliche Schutzschicht zu schaffen.

Öffentliche Aussagen von Musk: Im Januar dieses Jahres schrieb Musk auf X, er „wisse nichts von Nacktbildern Minderjähriger“ und behauptete, „bei der Bildgenerierung werde jede illegale Anfrage abgelehnt.“ Die in der Klage vorgelegten Daten widersprechen dieser Aussage direkt.

Schadensersatzforderungen: Die Opfer fordern mindestens 150.000 USD pro Verstoß gemäß dem Martha’s Act, zusätzlich die Rückforderung illegal erzielter Gewinne, Strafschadensersatz, Anwaltskosten und eine dauerhafte einstweilige Verfügung. Zudem fordern sie nach kalifornischem Wettbewerbsrecht die Rückgabe der Profite.

Daten des „Center for Countering Digital Hate“: Alle 41 Sekunden ein Bild

Die Klage zitiert Daten des „Center for Countering Digital Hate“, um die Vorwürfe zu untermauern:

Zeitraum: 29. Dezember 2025 bis 9. Januar 2026 (ca. 11 Tage)

Bildanzahl: Grok hat in diesem Zeitraum etwa 23.338 kindliche Sexualbilder erstellt

Generierungsrate: Durchschnittlich alle 41 Sekunden ein Bild

Verbreitung: Die Inhalte wurden auf mehreren Plattformen in anonymen Content-Handelsgemeinschaften verbreitet. Mindestens eine der betroffenen Personen wurde erst durch einen anonymen Hinweis erfahren, dass ihre Bilder gehandelt werden.

Globale Regulierung im Gleichschritt: Sechs Jurisdiktionen ermitteln gleichzeitig

Dieser Fall ist kein Einzelfall, sondern Teil einer globalen systematischen Überprüfung der Bildsicherheit von Grok AI:

Australien: Die unabhängige E-Sicherheitsbeauftragte Julie Inman Grant warnt vor zunehmenden Problemen bei der nicht freiwilligen Generierung von kindlichen Sexualbildern. Die Zahl der Beschwerden hat sich in den letzten Monaten verdoppelt, einige betreffen potenzielle Kinderpornografie.

Irland: Die Datenschutzkommission (DPC) hat gemäß irischem Datenschutzgesetz eine offizielle Untersuchung gegen X Internet Unlimited Company (XIUC), das für X in der EU zuständig ist, eingeleitet.

USA, EU, Großbritannien, Frankreich: Es laufen parallele Untersuchungen, was einen beispiellosen internationalen Regulierungsdruck bedeutet.

Häufig gestellte Fragen

Wie könnten sich die Sammelklage gegen die mögliche „Plattformhaftung“ von xAI auswirken?

Alex Chandra, Partner bei der IGNOS-Rechtsallianz, meint, das Gericht werde wahrscheinlich keine einfache Plattformverteidigung akzeptieren. Er erklärt, dass generative KI-Systeme auf Nutzerinteraktionsebene „als Plattform“ gelten könnten, aber bei Sicherheitsdesigns „als Produkt“ betrachtet werden sollten. Besonders bei CSAM-Fällen, bei denen der Schutz von Kindern im Vordergrund steht, gelten „besonders strenge Prüfstandards“. Unternehmen müssten vor der Einführung Risikoanalysen und Sicherheitsmaßnahmen vorlegen, um ihre aktive Präventionspflicht nachzuweisen.

Was ist der Martha’s Act und warum ist er hier relevant?

Der Martha’s Act ist ein US-Bundesgesetz, das speziell die Herstellung, Verbreitung und den Besitz von CSAM regelt. Es sieht strenge zivil- und strafrechtliche Verantwortlichkeiten vor, wobei jede Verletzung mindestens 150.000 USD Schadensersatz nach sich zieht. Der zentrale Streitpunkt ist, ob xAI als „Urheber“ von CSAM eingestuft werden kann und ob die Drittanbieter-Lizenzstruktur die direkte Verantwortlichkeit ausschließt. Diese rechtliche Abgrenzung könnte die Verantwortlichkeitsrahmen für die gesamte Branche der KI-generierten Inhalte maßgeblich beeinflussen.

Welche potenziellen Auswirkungen hat dieser Fall auf die zukünftige Entwicklung von KI-Bildgenerierungstechnologien?

Dies ist einer der ersten Fälle, in denen KI-Unternehmen direkt für die Generierung von erkennbaren minderjährigen CSAM verantwortlich gemacht werden. Wenn das Gericht xAI die direkte Verantwortlichkeit für missbräuchliche Ausgaben ihrer Modelle zuschreibt, wird die Branche gezwungen, vor der Veröffentlichung deutlich strengere Sicherheitsprüfungen durchzuführen. Dazu gehören verpflichtende Red-Teaming-Tests, Inhaltsfilter und vorab festgelegte Beschränkungen für risikoreiche Generierungen – was die kommerzielle Freigabe von generativen KI-Modellen grundlegend verändern könnte.