エッジAIと分散型推論:低遅延、データ主権、ハイブリッドトポロジーにおけるエンジニアリング上のトレードオフをどのようにバランスさせるか

テストクラスターから実際のビジネスアプリケーションへとインファレンスワークロードが拡大するにつれ、最適なソリューションは「全てを超大規模データセンターに集中させる」だけではなくなります。本記事では、レイテンシ、帯域幅、可用性、コンプライアンスの観点から、エッジノード、地域データセンター、中央クラスターの階層ロジックを検証します。ハイブリッドトポロジーにおけるタスク分割、データ境界、運用ガバナンスの要点を解説し、より広範なAIインフラチェーンと比較した概要を提供します。

一般的な説明では、AIハッシュパワーは「超大規模データセンター+高性能GPU」と同義とされることが多いです。トレーニングや一部の集中型インファレンスシナリオでは、この定義が概ね当てはまります。AIインフラストラクチャは、広範に分散され、レイテンシに敏感で、データがドメイン内に留まる必要があるインファレンスリクエストを特徴とし、ネットワーク障害やピーク時の混雑は許容できません。この場合、インファレンストポロジーはインフラの課題となり、ハッシュパワーは「利用可能」であるだけでなく、「適切な地理的位置とネットワーク層」に配置される必要があります。

AIインフラをチップレベルからサービス・ガバナンスまで連続したチェーンと捉える場合、本記事はトポロジーとデプロイメント形態に焦点を当てています。エッジ・地域・中央層間でコンピュートとデータをどう配分し、レイテンシ、コスト、可用性、コンプライアンスをバランスさせるかを解説します。電源、パッケージ、HBMなどの上流テーマはサプライ側の議論が適し、エンタープライズレベルのマルチモデルルーティングやエージェントガバナンスの詳細は運用補完となります。

なぜ「分散型インファレンストポロジー」を議論するのか

集中型インファレンスは統一運用、柔軟なスケーリング、高いリソース効率を提供します。しかし、ビジネスが以下の特徴を持つ場合、トポロジーの選択が体験とコストに大きく影響します:

-

強いレイテンシ制約:産業制御、リアルタイムインタラクション、音声・映像リンク、オフライン小売などはテールレイテンシに敏感で、過度なリターンパスがジッターを増幅します。

-

データ主権・居住要件:個人情報、金融取引、行政サービス、医療などは、データがドメイン内・国境内・指定地域内に留まる必要があります。

-

リターン帯域幅・コスト:膨大なエンドポイントが生データを中央インファレンスへ継続的にアップロードする場合、バックボーンネットワークや出口料金が主要コスト要因となります。

-

可用性・レジリエンス:広域ネットワーク障害、DNS変動、地域間混雑時は、純粋な中央型アーキテクチャが「サイト全体の不可用性」リスクの連鎖を招きやすくなります。

-

オフラインまたは弱ネットワーク:鉱山、船舶、特定の製造現場などは、リアルタイムオンライン接続への強い依存ではなく、ローカル運用能力が求められます。

これらの課題は「より強力な中央モデル」だけでは解決できません。核心は物理的距離、ネットワーク経路、ポリシー境界にあり、単一インファレンスのピークハッシュパワーにはありません。

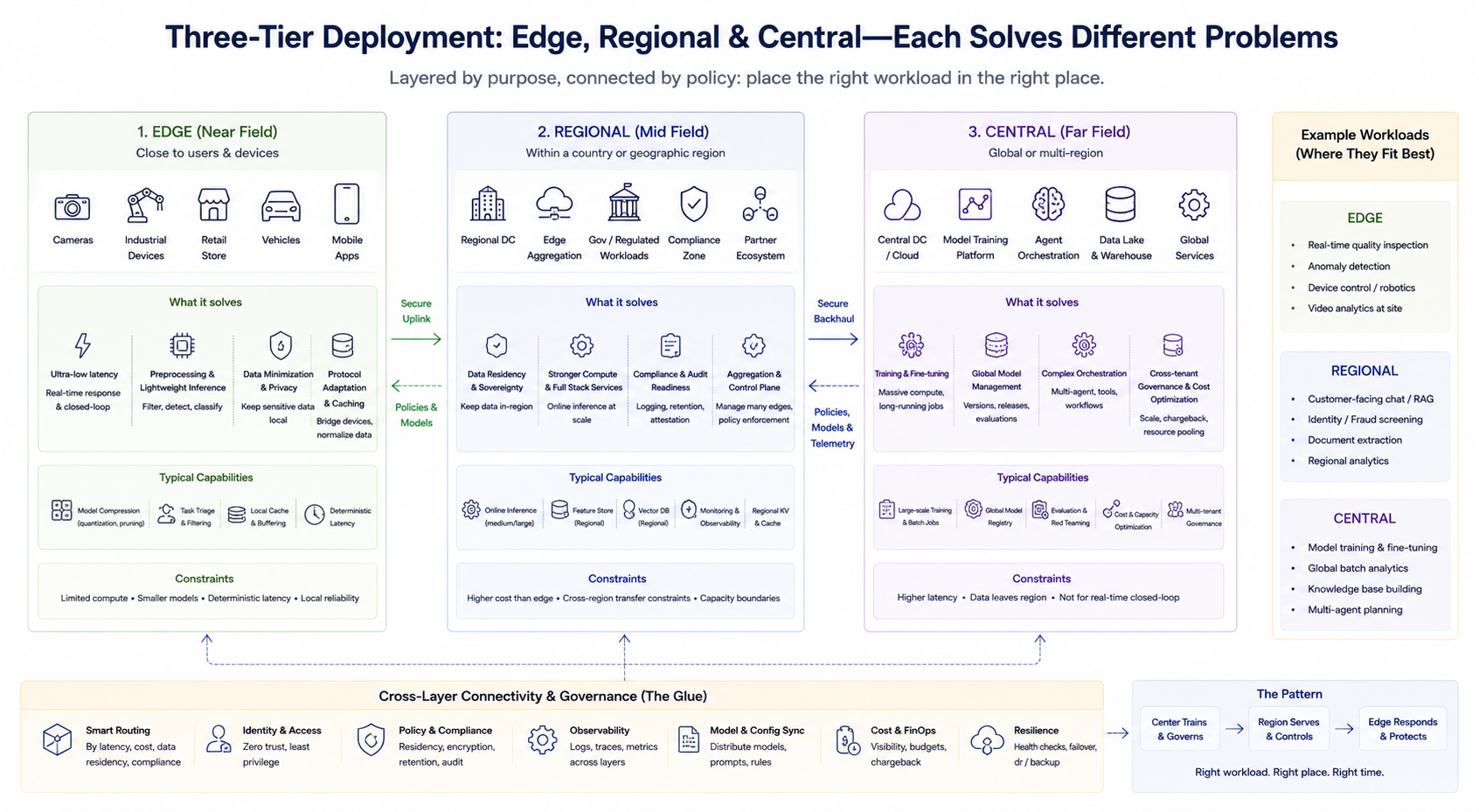

階層型デプロイメント:エッジ・地域・中央層は何を解決するか

典型的なエンジニアリングアプローチは二択ではなく、階層の組み合わせです。簡易フレームワークにより各層の役割を明確化できます(名称はプロバイダーごとに異なる場合があります):

エッジ層(近距離)

ユーザーやデバイスに近い位置にあり、低レイテンシの前処理、軽量インファレンス、キャッシュ、プロトコル適応を担当します。リアルタイムクローズドループやセンシティブデータのアップロード最小化に理想的です。エッジのハッシュパワーは通常限定的なため、モデル圧縮、タスク削減、決定的レイテンシが重視されます。

地域層(中距離)

特定国や地理的地域内でより強力なハッシュパワーと完全なサービススタックを提供し、データ居住、コンプライアンス監査、中規模集約インファレンスニーズに対応します。また複数エッジノードの集約・制御プレーンとして機能することも多いです。

中央層(遠距離)

トレーニング、大規模バッチ処理、グローバルモデル管理、複雑なエージェントオーケストレーション、統一クロステナントガバナンス、コスト最適化を担当します。レイテンシに敏感でないが高いハッシュパワーやデータ集約が必要なワークロードに適しています。

これら3層は固定階層ではなく、ビジネスタスクで分割されます。企業は中央トレーニング、地域オンラインインファレンス、エッジリアルタイム検知を同時運用し、ルーティング戦略に応じて適切な層へリクエストを振り分けます。

タスク分割:何がエッジに残り、何が中央へ戻るか

分割原則は通常、データ最小化、レイテンシ予算、モデル複雑性、更新頻度の4軸で構成されます。

エッジに適したタスク(ハッシュパワー要件を満たす場合):

-

リアルタイム特徴抽出、物体検知、品質スポットチェックなど低レイテンシのクローズドループ

-

ローカルで非センシティブ化後の軽量インファレンス(例:生メディアではなく特徴ベクトルのみアップロード)

-

弱ネットワーク環境でのフォールバックインファレンスやキャッシュヒット戦略

中央または地域に適したタスク:

-

大きなコンテキスト、強力なモデル、複雑なツールチェーン、マルチシステムオーケストレーションを要するエージェントワークフロー

-

部門横断データ集約を要する分析系インファレンス

-

中央監査や統一鍵管理が必要なセンシティブコール

よくある分割ミスは、長いコンテキストの大型モデルをエッジに強制しOOMを招く、または低レイテンシ要求のクローズドループを全て中央へ送って生産ラインのリズムを乱すことです。トポロジー設計の目的は「エッジを増やすほど良い」ではなく、制約下で最適なワークロードを適切な場所へ配置することです。

データ主権・コンプライアンス:トポロジーがアーキテクチャを決定する

データ主権要件はインファレンスデプロイメント形態を直接変更します。モデルはローカルにダウンロード可能ですが、ログ、キャッシュ、ベクトルインデックス、コールトレースは依然としてコンプライアンスリスクとなり得ます。実務上の主な論点は:

-

どのデータをエッジまたは地域層で保存・計算する必要があるか

-

どのメタデータが地域外やクラウドへ出られるか、匿名化や保持期間が必要か

-

異なるモデルバージョンやベンダーの地域間利用が許容されるか(「コンプライアンスドリフト」回避のため)

-

監査・フォレンジック時に「特定の場所・時刻・データ断片に基づき生成された」アウトプット再構成が可能か

これらの答えが、システムの稼働可否を左右することが多く、「モデルがオープンソースか否か」より重要です。つまり、コンプライアンスはエッジインファレンスの付加要件ではなく、トポロジー設計のインプット条件です。

ネットワーク・電源・運用:分散型デプロイメントの実際のコスト

分散型インファレンスは計画段階で明示的に評価すべきシステムコストを伴います:

-

ネットワーク:エッジ・地域ノードが増えると、証明書管理、専用線/SD‑WAN、DNS、トラフィックスケジューリングの複雑度が上昇します。マルチパス環境下ではテールレイテンシの統制が困難です。

-

電源・データセンター:エッジサイトは分散され、単位ハッシュパワーあたりのエネルギー効率や冷却条件は大規模データセンターより劣る場合があります。地域データセンターは中間的です。上流の電源・ラック納入ペースが拡張速度を制約しますが、制約は「単一キャンパス」から「多点並行」へ移行します。

-

運用・バージョン整合性:モデル、プロンプト、ルーティング戦略、インデックスが多点でリリースされるとバージョンドリフトが発生します。統一リリースパイプライン、ロールバック戦略、ヘルスチェックが必要で、これがなければエッジのレイテンシ改善効果が運用コストにより相殺されます。

-

セキュリティ範囲拡大:ノード増加は証明書・エントリーポイント・ローカルストレージメディア増加を意味します。エッジの物理セキュリティやパッチサイクルは中央データセンターより弱い場合が多く、最低権限・リモート制御戦略が不可欠です。

従って、分散型トポロジーは単に「ハッシュパワーを遠方へ押し出す」ことではなく、運用・ガバナンスの複雑性の一部をビジネス現場へ近づけることです。組織能力やプラットフォームツールが追いつかなければ、トポロジーの利点は十分に発揮できません。

集中型インファレンスとの関係:ハイブリッドアーキテクチャの実装方法

成熟したソリューションの多くはハイブリッドアーキテクチャを採用しています。中央はトレーニング、グローバルポリシー、重いワークロードを担当し、地域はコンプライアンスゾーン内のオンラインサービスを担当し、エッジは低レイテンシ・ローカルレジリエンスを担当します。よくあるエンジニアリングパターンは:

-

階層キャッシュと結果再利用:エッジが高頻度リクエストを処理し、ミスは中央へ送信。キャッシュキー、TTL、センシティブデータポリシーの定義が必要です。

-

モデル分割と小型モデルフロント:エッジで検知・分類の小型モデル、中央で大型モデルの融合・解釈生成(シナリオごとに評価)。

-

非同期リターンと集約:エッジでリアルタイム意思決定し、非同期で非センシティブ化サンプルや指標を中央へ返してモデルイテレーション・モニタリング。

-

統一制御プレーン:ルーティング、クォータ、モニタリング、鍵管理を可能な限り中央集約し、実行は分散化することで「各エッジが孤立島化する」リスクを低減。

ハイブリッドアーキテクチャ成功の鍵は、統一制御プレーン+階層実行プレーンであり、単にノード数を増やすことではありません。

結論

エッジ・分散型インファレンスの議論の本質は「分散化スローガン」ではなく、レイテンシ、帯域幅、コンプライアンス、運用コストのエンジニアリング上のトレードオフです。ビジネスがデモからスケールへ進むにつれ、トポロジー選択がモデル形態、ネットワークアーキテクチャ、組織プロセスを規定します。この層を軽視すると、中央の強力なハッシュパワーがあっても現場の不安定さが残り続けます。

関連記事

Render、io.net、Akash:DePINハッシュレートネットワークの比較分析

AI分野におけるRenderの申請理由:分散型ハッシュレートが人工知能の発展を支える仕組み

USD.AI 収益源分析:AIインフラ借入資金による収益創出の仕組み

USD.AIトケノミクス:CHIPトークンの使用事例およびインセンティブメカニズムのデプス分析

GateClawとAI Skills:Web3 AIエージェント能力フレームワークの徹底分析