GPU価格がなぜ制御不能な上昇を続けているのか?

原文タイトル:The Great GPU Shortage – Rental Capacity – Launching our H100 1 Year Rental Price Index

原文作者:Daniel Nishball、Jordan Nanos、Cheang Kang Wen 等

編訳:Peggy,BlockBeats

編集部メモ:AIが「ツール」から「ワークフロー基盤インフラ」へと移行するにつれて、GPUレンタル価格は上昇加速の局面に入り、供給は継続して逼迫しています。

H100の1年物価格が約40%上昇したことから、計算能力が2026年後半まで前倒しでロックされること、さらにAIラボが長期契約と更新メカニズムによって供給を継続的に確保していることまで——GPU市場の運用ロジックは明らかに変化しました。価格はもはや主にハードウェアコストによって決まるのではなく、token消費、モデル性能、生産効率が共同で形作っているのです。

需要側の変化がとりわけ重要です。マルチエージェントシステム、ネイティブコンテンツ生成、AIプログラミングツールなどの新しいパラダイムが、token利用を指数関数的な成長レンジへ押し上げています。レポートの中核的な見立ても次第に明確になってきました。AIツールの投資対効果(投入・産出比)はすでに検証済みで、5〜10倍のリターンにより、計算能力の価格がかなり長い期間、需要に対して有効な制約をかけることが難しいのです。

こうして生まれた緊張は、ますます鮮明です。現実の計算能力市場は全面的な逼迫と価格決定権の上方移動を示している一方で、資本市場はなお「いずれ過剰となり、商品化する」という期待のままにとどまっています。この期待と現実のズレが、AI基盤インフラ分野のバリュエーションロジックを作り替えています。

計算能力が新たな生産財になると、その価格メカニズム、供給構造、資本リターンは、いま大きな局面で再構築のただ中にあります。

以下は原文:

Anthropic の Claude 4.6 Opus と Claude Code の需要が大幅に急増しています。その年間経常収益(ARR)は、わずか1四半期の間に、昨年末の 90 億ドルから現在の 250 億ドル以上へと跳ね上がり、ほぼ3倍の成長を実現しました。同時に、GLM、Kimi K2.5 を代表とするオープンソースモデルも、オープンソースモデル関連のアプリケーションシナリオの急速な拡大を後押ししています。Anthropic、OpenAI、そして複数の Neolabs を含む企業が継続的に資金調達を行っていることも、GPUリソース需要の高まりを加速させています。

この転換点は、需要が短期間で急激に上昇し、超大規模クラウド事業者(hyperscalers)や新興クラウドサービス事業者(Neoclouds)において GPU の奪い合い(pre-buying)が発生していることを意味します。

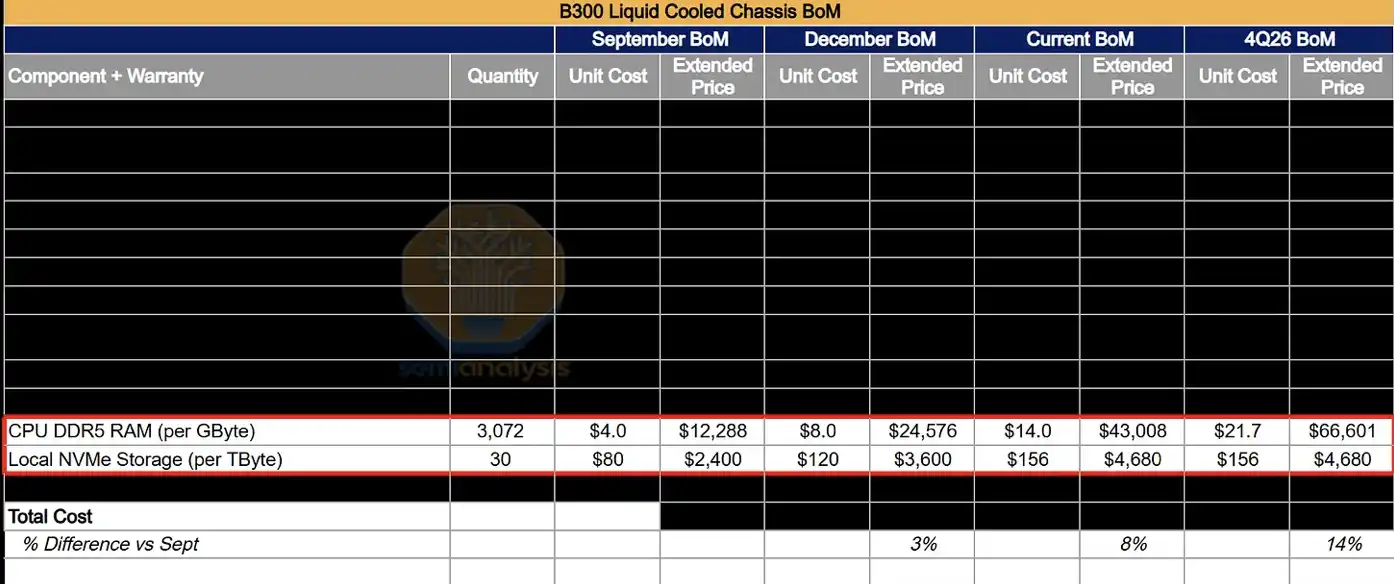

この新たな需要は、サプライチェーン全体を通じて価格を押し上げています。DRAM と NAND のストレージから、光ファイバケーブルやデータセンターのホスティング、そしてガスタービンのようなインフラに至るまで、関連するほぼすべての商品とサービスで値上がりが起きています。

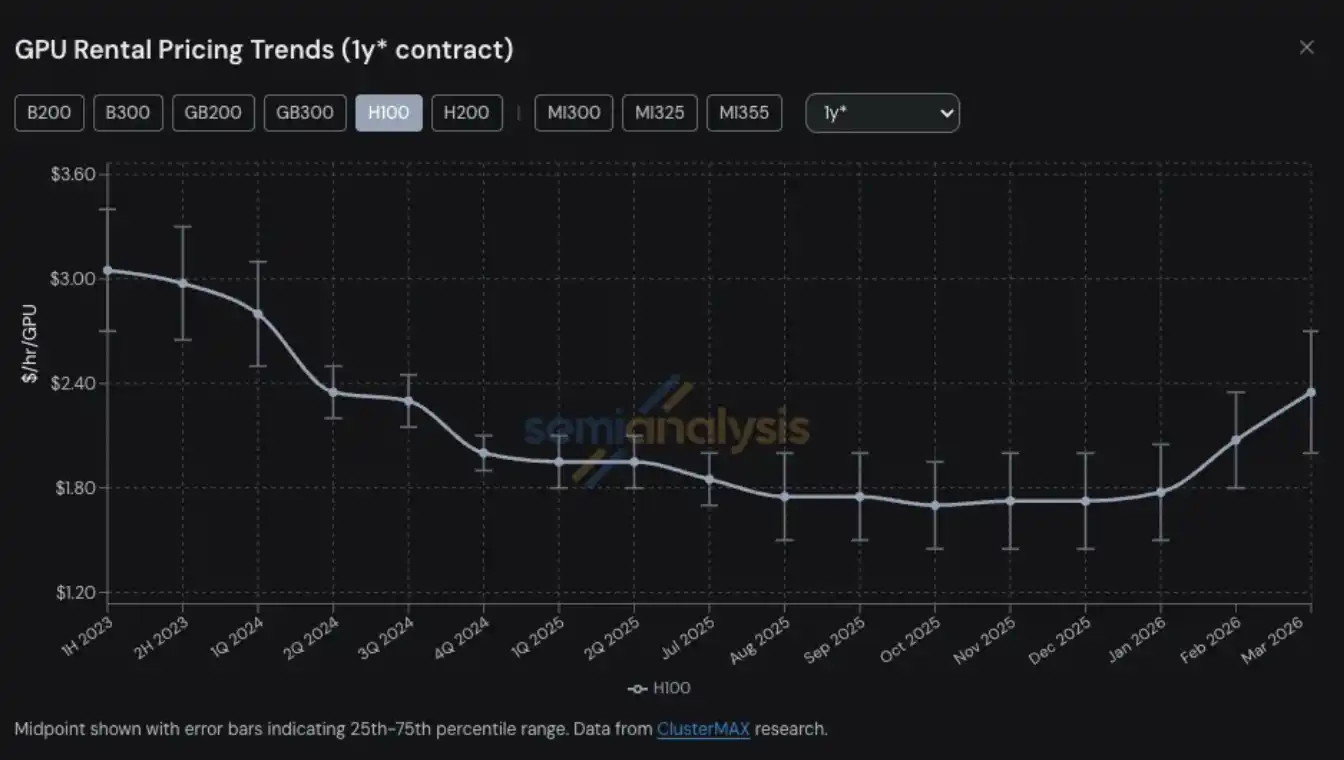

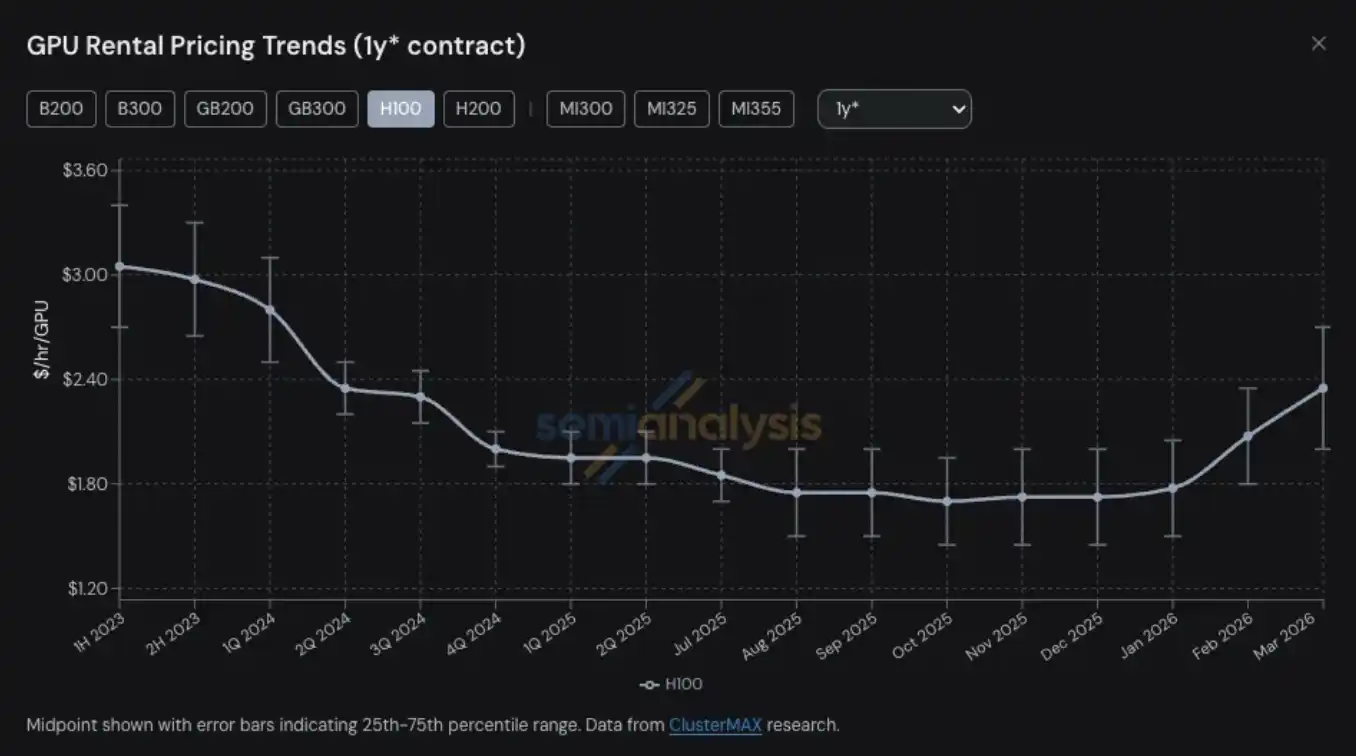

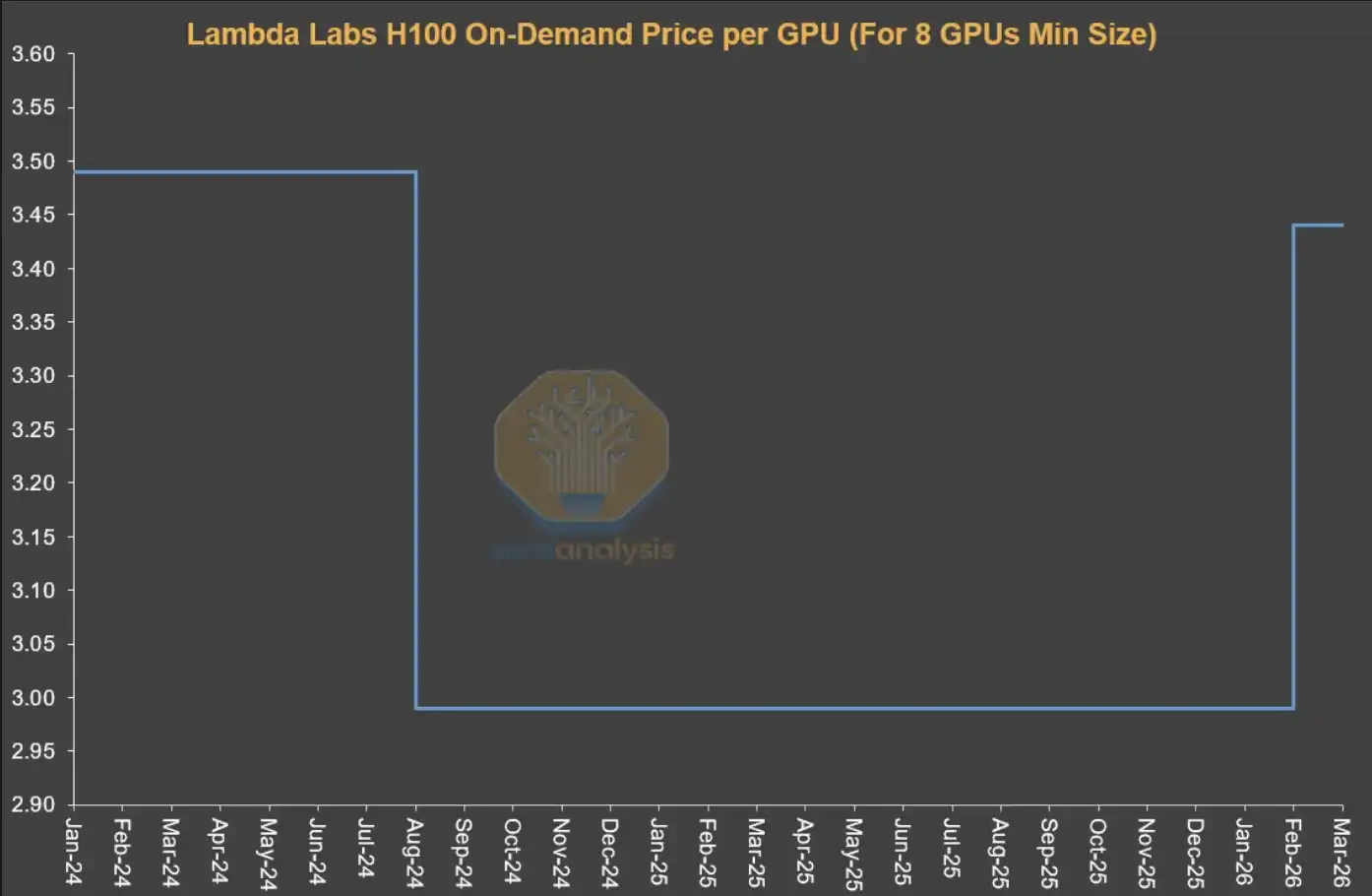

GPUレンタル価格は、計算能力関連の多くの商品・サービスの中で、最も新しく「供給逼迫と価格急騰」が見られる領域となっています。H100 の1年物 GPUレンタル契約価格は、2025年10月の安値(1GPUあたり1時間 1.70ドル)から、2026年3月の 2.35ドルへと上昇し、上昇率は約40%です。

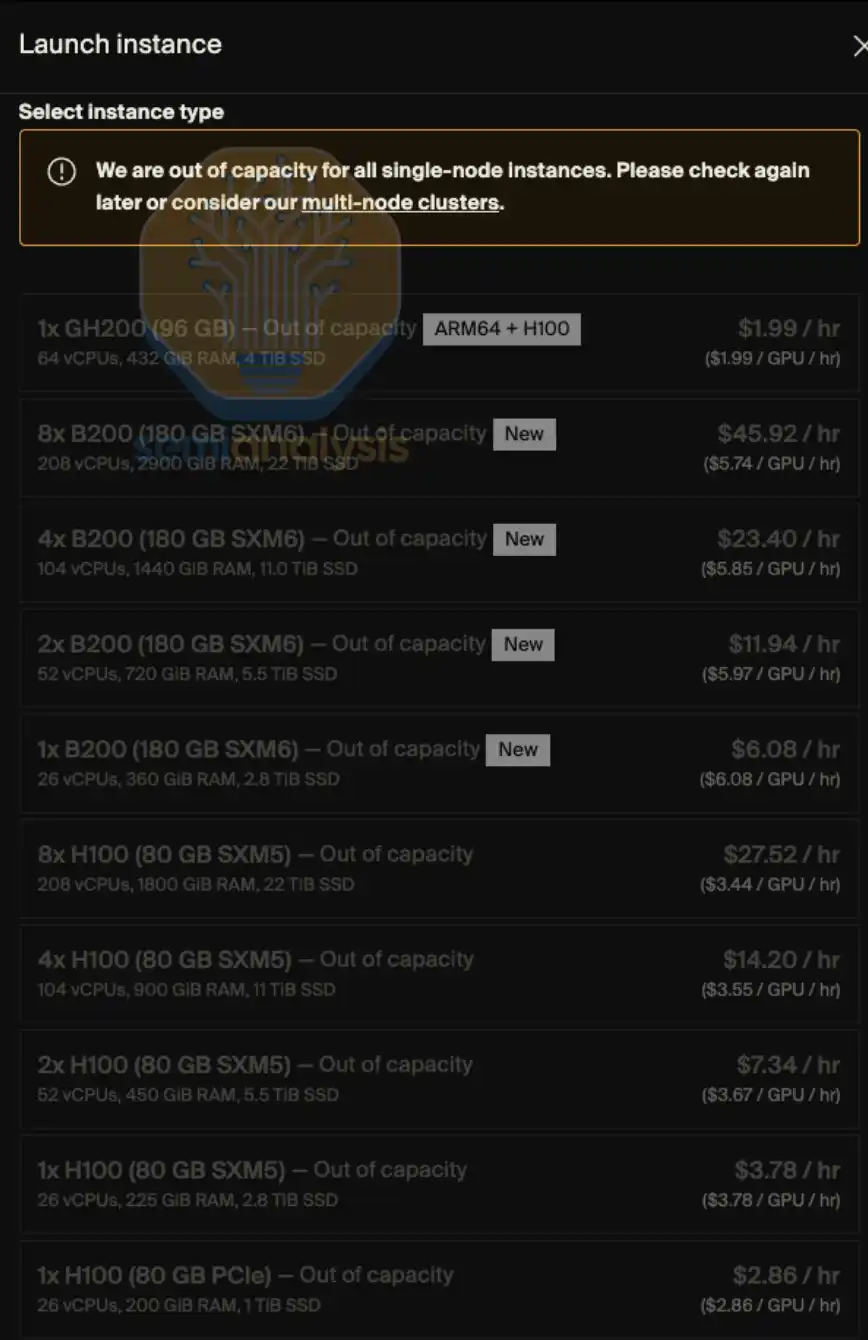

オンデマンド(on-demand)GPUレンタルのキャパシティは、あらゆる型番でほぼすべて売り切れています。オンデマンド・インスタンスをすでに確保しているユーザーは、価格が上がった後でも計算能力を市場に戻したがりません。2026年初めにGPU計算能力を探す難しさは、まるで「最後の便」の航空券を奪い取ろうとするのに近いものです。価格は高騰し、ほとんどチケットはありません。より適切な比喩を使うなら、航空券を奪い合うというよりは、「ルートを探して薬を買う」ような状況です。

SemiAnalysisでは、Neocloud と超大規模クラウドエコシステムにおける各種トレンドや重要テーマを長期にわたって深く追跡しており、その中には GPUレンタル価格も含まれます。この能力は、ClusterMAX、InferenceX、そして AIクラウドの総保有コスト(TCO)などのプロジェクトにおける継続的な研究と実践に由来しています。

同時に私たちは、多くのAIラボが Neocloud サービスプロバイダーと連携できるよう、大きな労力を投じています。市場でGPUレンタルリソースを探し、エコシステム内のほぼすべての関係者と継続的に対話しながら、GPUレンタル価格の変化トレンドを把握しています。

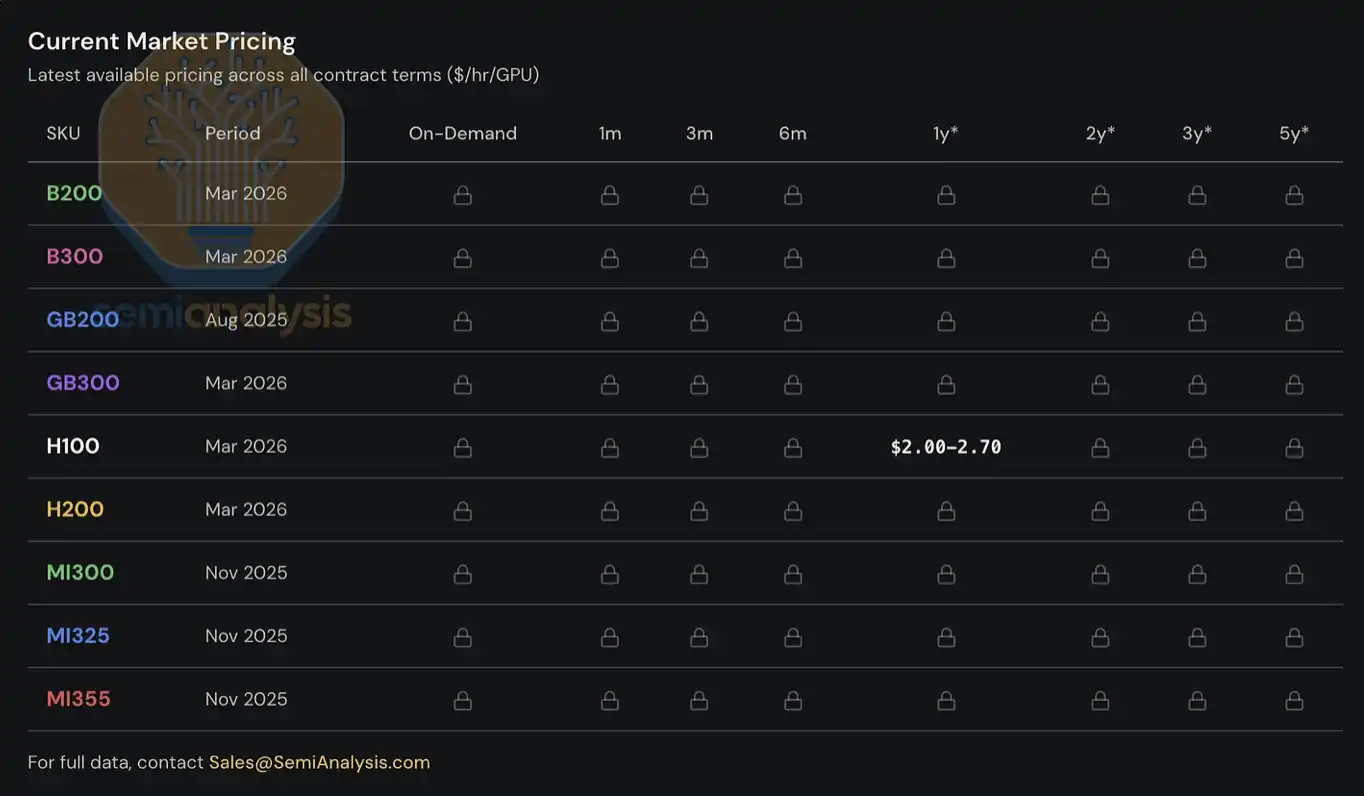

2023年以降、私たちは顧客向けに、GPUレンタル価格指数の体系を構築・維持してきました。H100、H200、B200、B300、GB200、GB300、MI300、MI325、MI355 のような主要なGPU型番をカバーし、オンデマンド(on-demand)から1か月の短期レンタル、最長5年の長期契約まで、さまざまなレンタル期限にまたがっています。この指数は複数の Neocloud サービスプロバイダーと計算能力の買い手への調査データに基づいて構築され、実際の取引データ、ならびに私たちが参加して行う折衝(交渉)と成約状況によってクロスバリデーションされています。

本日、私たちは H100 の1年物 GPUレンタル価格指数を一般公開します。業界により多くのデータと洞察を提供することが目的です。この指数は月次で更新し、X および LinkedIn を通じて最新のトレンド解説や市場観察も継続的に発信します。さまざまなレンタル期限構造や他の主要GPU型番をカバーする完全な価格データについては、現時点では、当社の AIクラウドTCOモデルを購読している機関ユーザーのみが対象です。

このレポートは、GPUレンタル市場の最新トレンド、市場フロントラインの観察、そして重要なデータを中心に展開し、私たちが市場全体の構造をどのように理解しているのかを解きほぐし、また将来のレンタル価格の方向性について初期の見立てを示します。

GPUレンタル市場が「ダイナミック・プライシング」の段階へ

H100 の1年物レンタル価格カーブだけを見ても、市場の逼迫度を完全に表すにはまだ足りません。実際に前線で計算能力を確保する中で得られた経験と、市場参加者から寄せられたフィードバックが反映している状況は、さらに厳しいものです。

現在の需要は複数の高度に異質な利用シナリオから生まれており、「汎用的な解決策」はほぼ存在しません。たとえば推論側では、大規模混合専門家モデル(MoE)は GB300 NVL72 のような最新の大規模システムで動かすのにより適しています。一方、学習側では H100 が依然としてコストパフォーマンスの面で優位性を持つため、たとえ比較的「旧世代」のGPUであっても需要は高止まりしています。

顧客は現在、1GPUあたり1時間 14ドルの AWS p6-b200 のスポット型インスタンス価格まで、競って支払う状況にあります。いくつかのトップクラスの Neocloud サービスプロバイダーは、もはや単一ノードを売らなくなっています。さらに、ある H100 の更新(リニューアル)価格が、なんと2〜3年前に契約したときとまったく同じ水準になっているケースすらあります。加えて、いくつかの H100 契約はすでに 2028 年まで更新されており、リース期間は最大4年です。いま、たとえ 8ノード(64枚のGPU)に相当する H100 あるいは H200 クラスターを探そうとしても容易ではありません。私たちが問い合わせたサービスプロバイダーの半分はすでに完全に売り切れ。多くのサービスプロバイダーの回答は次のとおりです。「そもそも、直近の契約満了でHopperアーキテクチャのGPUが放出されることはない」。

私たちはさらに、ある計算能力の借り手が、自分たちが借りたクラスタを再び分割し転貸し始めているとも聞きました。まるでモナコ・グランプリ期間中にアパートを分割して短期賃貸にするようなものです。次にいわゆる「Neocloudの二次貸し(Neocloud二房东)」が出てくるのかどうかは、冗談ではなくなるかもしれません。

Blackwell の供給も同様に極めて逼迫しています。私たちは把握していますが、オープンソースの重みモデルの需要が強く、推論需要が継続的に爆発していることを背景に、新たな Blackwell クラスタのデプロイ/納品リードタイムは現在、6月〜7月まで延長されています。さらに、これから稼働予定のクラスタの多くは事前にロック済みです。実際、マーケット全体を見ると、2026年8月〜9月に新規稼働するキャパシティでさえ、ほぼすべて予約で埋まっています。

GPUレンタル価格:巻き戻って戻ってきた

では、市場はなぜここまで来たのでしょうか? 6か月前には、ほとんどの市場観測者が GPU の「終局価値(終値)」に懐疑的であり、GPUレンタル価格は時間とともに不可避的に下がり続けると考えるのが一般的でした。当時、もし Neocloud や超大規模クラウド事業者が財務モデルでGPUの計算能力資産を6年の減価償却期間で処理していたなら、金融アナリストから批判されていたかもしれません。将来トレンドを議論する前に、事態がどのように進んできたのかを簡単に振り返ります。

2025年下半期に入る前は、生態系全体の主流見通しは一貫してこうでした。Blackwell の大規模導入が進み、かつ単位計算能力コストが大幅に低下するため、Hopper(つまり H100 と H200)のレンタル価格は明確に下がるはずだ、と。しかし実際は逆でした。2025年下半期になると、H100 の需要は弱まらず、多くの場面でさらに強まっています。オープンソースの重みモデルが急速に普及したこと、そして当時の推論需要が継続的に加速していたことが、ほとんど止まることのない計算能力需要の波の最初のシグナルでした。

2026年1月になると、計算能力市場は次の転換点を迎えます。DRAM と NAND のストレージ価格が、数四半期にわたって急上昇した後、ほぼ「放物線状」の爆発局面に入ったのです。私たちのストレージモデルによると、2026年の第1四半期には、LPDDR5 と DDR5 の契約価格の前年同月比の上昇率が、それぞれ約4倍および5倍に迫っています。

部品コストの急騰がもたらす利益率リスクに対処するため、OEMメーカーはAIサーバーの販売価格を引き上げ始めました。そして値上げ幅は、基礎となる部品コストの上昇幅そのものよりもはっきりと大きいものでした。これにより、クラスターの資本支出(CAPEX)判断は一層複雑になります。より高いサーバー調達コストがプロジェクトの見込みリターンを圧迫し、一部のオペレーターが導入のペースを緩めたり、場合によっては案件そのものを見送ったりすることを余儀なくされました。その結果、当初なら導入されていたはずの一部の新規供給が延期または棚上げとなり、レンタル市場の逼迫がさらに強まることになりました。

「AIサーバーの価格暴走」によって引き起こされた調達の混乱の中で、GPUレンタル需要は著しく加速し、市場に残っていた計算能力のほぼすべてが1月と2月で完全に消化されました。3月には、H100、H200、B200のいずれであっても、どのレンタル期間でも利用可能なキャパシティをほぼ見つけることができません。1年物のレンタル価格は1月末に1GPUあたり1時間 2ドルを突破し、2月中下旬には1月末からさらに 15%〜20% 上昇しました。3月末までには、四半期(前月比)ベースでさらに 15%〜20% 上昇する見込みです。

今年初めの需要の重要なドライバーの一つは、ネイティブ・メディア生成(native media generation)です。Seedance、Nano Banana のようなアプリは、ユーザーが規模化して画像や動画を生成・反復できるようにし、それにより token のスループットを大きく引き上げています。しかし、より重要で、かつより目に見える需要源は、マルチエージェント(multi-agent)ワークロードの台頭です。これらのシステムは複数ステップのプロセスを実行し、高い同時並行環境の中で継続的に反復するため、token消費と計算能力需要は「指数関数的」な成長を示すようになっています。

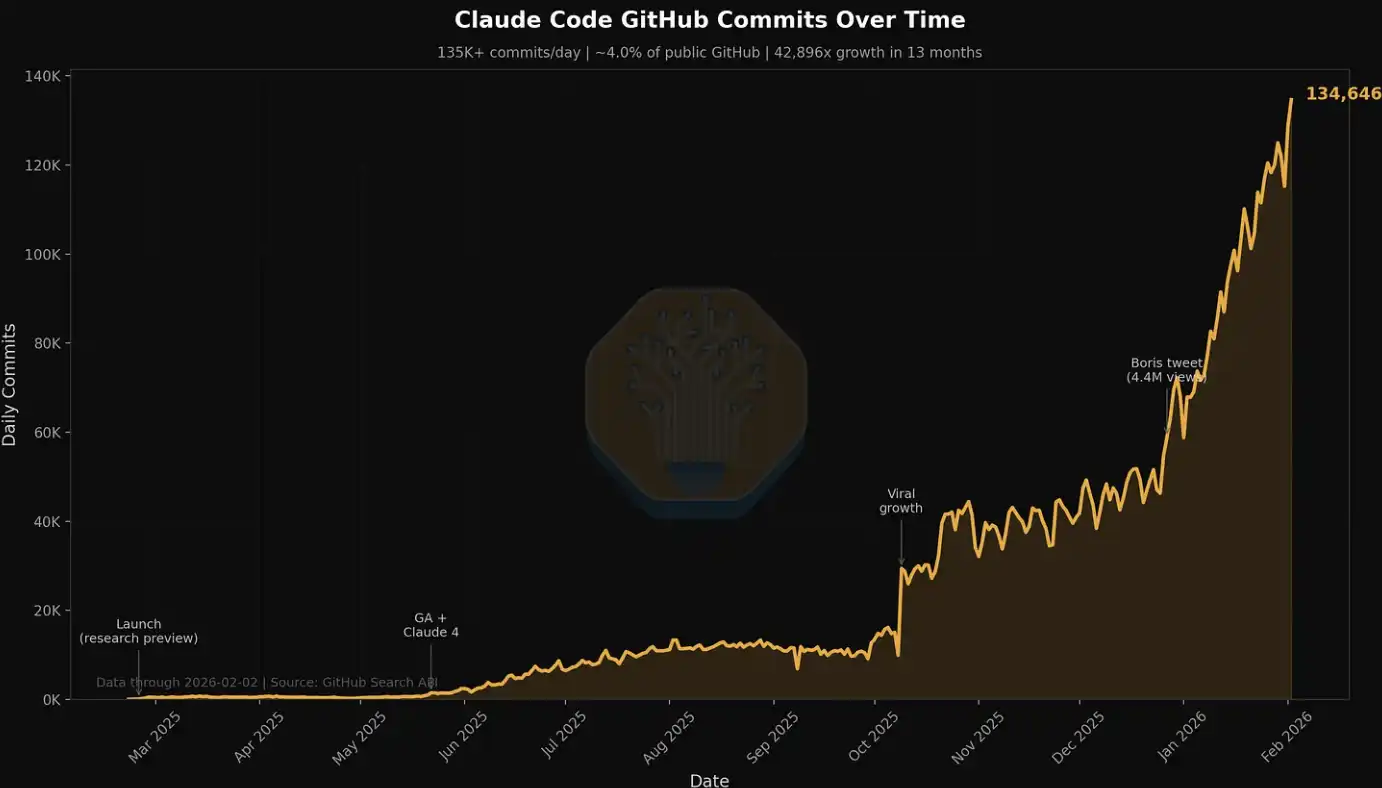

このトレンドは Claude Code に関する関連データにも、特に顕著に表れています。私たちはこれまで複数の記事で触れてきました。たとえば SemiAnalysis では、直近7日間だけでも、社内で数十億 token を消費しており、平均コストは約1百万 token あたり 5ドルです。しかし、それによって生まれる時間の節約、ワークフローの拡張、能力の向上は、コスト自体をはるかに上回っています。現在、SemiAnalysisは一式のAIツールを複数のワークフローに組み込み、単なる検索や要約にとどまらず、データダッシュボード、オートメーションによるスクレイピング、大規模データ処理、さらにエージェントに基づく金融モデリングなどの場面にも広げています。

私たちは Claude のデイリー提出量(Claude Commits Daily)などの指標でも、この需要の爆発的な増加を追跡しています。現在の傾向に基づけば、2026年末までに Claude Code はコード提出量の20%以上を占めると見込まれます。つまり、あなたが気づかないうちに、AI はすでにソフトウェア開発プロセス全体を「飲み込む」ことを始めています。このデータセットを入手したい機関のお客様は、当社のAPIチームまでご連絡ください。先に少しだけ明かしますが、この提出量は、私たちが最初に公開したときの水準をすでに明確に上回っています。

私たちの周りでは、ほぼ全員が Claude Code のヘビーユーザーです。ただし私たちは、この「界隈」自体がAIと半導体領域に深く没入している、いわば「最前線のごく一部の人たち」であることも理解しています。

《Fortune 500》の多くの企業、そしてより広い一般の人々にとっては、Claude Code と「エージェントの世界」は、少し新奇な周辺トピックにすぎず、FacebookのフィードやNPRのポッドキャストでたまに話題になる程度です。彼らはほとんどまだ認識していませんが、エージェントに駆動された生産性の波と構造的なインパクトが、迫りつつあります。

実体経済側のより多くの参加者が、AIツールを使うことによる驚異的な投資回収(投資対効果)に段階的に気づき、この「計算能力の波」に参加するにつれて、token消費は段階的(ステップ状)に上昇し続けるでしょう。AIの投入・産出比をめぐる議論は、実はすでに決着がついています。AIツールによって生み出される価値は、往々にしてそのコストの1桁以上に達します。こうした背景のもとで、token需要のカーブが右にシフトし続けることで、強力で(現段階では)相対的に弾力性が乏しい力が形成され、GPUレンタル価格は上昇し続けることになります。

簡単に言うと、もしAIツールの投資回収が5〜10倍に達するなら、GPUレンタル価格にはまだ相当な上昇余地があり、需要を本当に抑制するには至らない可能性が高いということです。さらに、レンタル価格の追加上昇が続き、上方へ波及してサーバーや中核部品のコストを押し上げていくことも、私たちは否定しません。

SemiAnalysis H100 1年物レンタル価格指数リリース

本日、SemiAnalysisの H100 1年物レンタル契約価格指数を無料で一般公開します。GPUレンタル価格のトレンドに対する市場の認知と透明性を高めることが目的です。

この指数は、100社超の市場参加者(Neocloudサービスプロバイダー、計算能力の買い手・売り手を含む)への月次調査データに基づき、GPUレンタル価格の代表的レンジ(第25パーセンタイル〜第75パーセンタイル)を決定するために用いられます。さらに、実際の取引データによるクロスバリデーションも行い、自社ネットワーク内で売り手と買い手をマッチングし、取引の一部に直接参加することで、価格水準をより精密に調整しています。

2023年以降、私たちは H100、H200、B200、B300、GB200、GB300 を含むGPUを継続的に追跡し、3か月〜5年という異なるレンタル期間の契約価格を対象にしています。同時に、AMDシリーズ(MI300、MI325、MI355)の関連データも取り入れています。

市場にすでにあるGPU指数と比べて、SemiAnalysisのH100 1年物契約価格指数にはいくつかの重要な違いがあります。

まず、多くのGPUレンタル指数はスポット/オンデマンド(spot/on-demand)の見積り価格や公開の掲示価格に基づいていますが、実際には、GPUレンタル取引の大半は長期契約で行われ、通常は6か月以上です。これらの価格は、二者間交渉によって形成され、公開データベースには現れません。多数の大手Neocloudサービスプロバイダーは、少なくとも1年の契約を結ぶことを好み、2〜3年がより理想的です。さらに5年の大口一括(包販売)契約を達成できるならなお良いでしょう。SemiAnalysisのH100 1年物レンタル指数は、まさにこの「契約市場」、つまり実際の取引量が最も集中している部分に焦点を当てています。特定のレンタル期間を明確に指し示すことで、この指数はユーザーにとってカバーする市場範囲の理解がしやすくなり、自己の観察とも照合しやすくなります。

次に、公開される価格は、実際の成約価格をそのまま表していません。超大規模クラウド事業者やNeocloudが公表する価格は、実際の取引水準というより、トレンド方向の参考として示されることが多いのです。これらの価格はしばしば、契約市場の変化より遅れて調整されます。通常、計算能力需要がすでに変わった後に調整が入ります。特にオンデマンド市場では、価格が比較的固定の水準に設定されることが多く、実際の需給変化は、稼働率やリソース占有率によって反映されます。必要なときにだけ不定期の調整が行われるのです。この市場メカニズムについては、記事の後半でもさらに展開します。

さらに、市場には大規模な見積り・価格・取引データを扱い、トレンド分析に強みがある指数も少なくありませんが、私たちのアプローチはより、市場参加者との直接的な関わりを重視しています。各見積り、各取引の背後には、固有の文脈と意思決定ロジックがあります。私たちは定量データを提示するだけでなく、こうした定性的情報と前線での観察を補うことで、GPUレンタル市場の実際の構造をより包括的に復元したいと考えています。

機関購読ユーザー向けには、ほぼすべての主流GPUレンタル市場に対応する、完全な期限構造データも提供しています。

H100 1年物の契約価格指数をリリースするのと同時に、機関向けTokenomicsモデル購読ユーザーには、最先端のAIモデルの構図を追跡・理解するための SemiAnalysis Tokenomics Dashboard も提供します。このダッシュボードでは、コード、推論、数学、エージェント評価など複数の次元で、カスタム比較が可能です。異なるモデルやサービスプロバイダーのAPI価格を比較し、主要なAIラボが開示する重要データ(token使用量、収益、バリュエーション、顧客規模など)も確認できます。

GPUレンタル市場の現在の構造

2025年下半期以前は、GPUレンタル市場の価格環境は比較的競争的でした。当時は、オペレーターがより多くのGPU在庫を持っており、終端需要が加速し始めたばかりの段階だったからです。そのため各Neocloudサービスプロバイダー間の競争は熾烈で、一般により魅力的な価格を提示して顧客を獲得しようとしていました。中核的な狙いは、稼働率を高め、次のGPUのイテレーション・サイクルが到来する前に、既存の計算能力資産からできるだけ価値を「搾り取る」ことです。

しかし、その後、市場の構図は180度転換しました。現在では、Neocloudと超大規模クラウド事業者はすでに完全に主導権を握っています。より高い前払金、より良い価格、より長い契約期間を要求でき、契約の開始・終了時期さえ自分たちで選び、自社の在庫や生産能力の手配に合わせることができるのです。加えて時間も供給側に味方しています。自分たちのペースでデプロイを進め、上昇し続ける価格環境の中で、最適な顧客構成を段階的に選別できるからです。

構造的に見れば、GPUレンタル市場は大きく3つのセグメントに分けられ、それぞれが異なるタイプの顧客需要に対応しています。

短期レンタル:オンデマンド、スポット、および3か月以内の契約

中期契約:3か月〜3年以上の契約

長期一括販売(offtake):4〜5年物の契約で、最も一般的なのが5年

短期レンタル:オンデマンド、スポット、3か月以内の契約

短期レンタルはレンタル期間構造の最前線に位置し、多くの場合「余剰キャパシティ」を指します。ただし、一部のサービスプロバイダー(Runpod、Lambdaなど)は、比較的規模の大きい、柔軟なオンデマンドまたはスポットの計算能力提供に特化しています。

注意すべき点は、オンデマンド市場の価格メカニズムが他の契約市場と大きく異なることです。通常、サービスプロバイダーはオンデマンド・リソースに対して比較的固定された価格水準を設定し、調整はごく限られた場合にしか行いません。言い換えれば、短期市場の価格はリアルタイムの需給によって直接駆動されるわけではなく、むしろリソース稼働率の変化によって市場の逼迫度が反映されるのです。

サービスプロバイダーは一般に、稼働率に応じて価格を一度だけ調整します。稼働率が低いときは、値下げによって需要を刺激し、稼働率が満載に近づくと、より高い価格水準でも需要が高位を維持できるため、価格を引き上げます。

これが、時系列で見るとNeocloudが公表するオンデマンド価格が、長い期間ほぼ不変のまま推移し、その後突然「ジャンプ式」に上昇または下落する理由です。オンデマンド市場にとって、需要の変化を高頻度で反映するのは価格そのものではなく、リソース稼働率なのです。

出所:Lambda Labs、SemiAnalysis

中期契約(Mid-Term Contracts)

経済的な意味合いからすると、より重要なのは「契約市場」です。GPUレンタルの取引価値の大半はこのセグメントで発生します。その中でも1年物の契約が特に重要です。非AIラボの顧客の限界需要を反映すると同時に、大口顧客からのあふれ需要(溢出需要)も示すため、市場が締まっている度合いを最も敏感に判断する指標になります。

AIネイティブ企業(AI Natives)および中小規模のAIラボは、主に1〜3年物のレンジで活動しています。ただし、最近の明確なトレンドとして、これらの機関もより長期の契約で計算能力を確保しようとし始めていることが挙げられます。多くは4年以上にまで延ばしており、前払いが20%以上になる支払いにも応じています。これは、過去4年以上の契約ではあまり見られなかったことです。

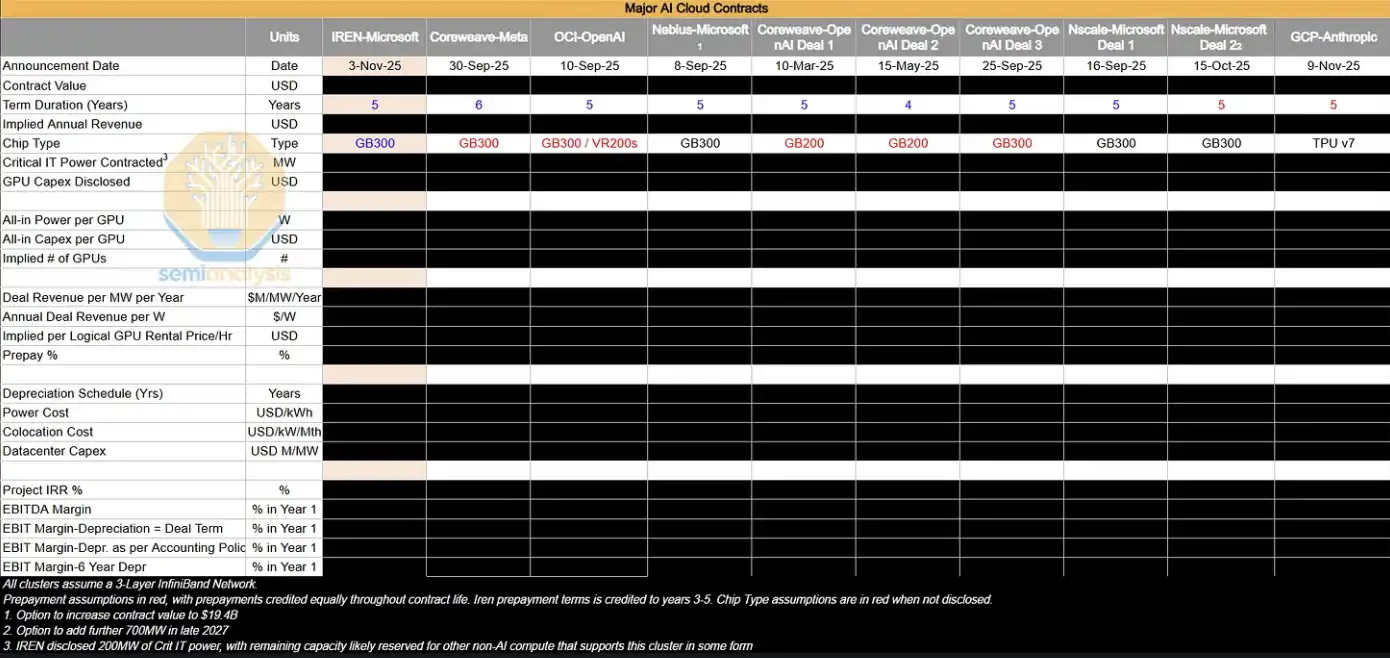

長期一括販売(Long-Term Offtakes)

より長期の4〜5年物市場を支配しているのは、大型のAIラボです。彼らは早い段階で大規模な計算能力をロックします。こうした取引は通常、50MW、100MW、あるいはそれ以上の規模のクラスタに対応し、だいたい 2.4万〜4.8万枚の GB300 NVL72 GPU に相当します。全体として、この種の長期一括販売(offtake)契約は、NeocloudのGPUレンタル市場においてかなり大きなシェアを占めています。

AIラボがこうした契約を好む理由は、大規模な計算能力を一度にロックすることで、急速に増える終端需要に対応できるからです。同時に、これらの機関は通常、ストレージ、ネットワーク、CPU構成などの重要な要素を含むクラスタの設計にも深く関与します。この種の取引は、多くの場合 裸金属(bare metal) の形で納品されます。AIラボには十分なエンジニアリング力があり、より底層で技術スタックをカスタムできるため、最適なTCO(総保有コスト)と性能を実現できます。

Neocloudサービスプロバイダーにとっても、この種の取引は魅力的です。第一に、販売リソースを少数の大口注文に集中でき、大量の小口顧客を処理する必要がなく、同じ収益を得られます。第二に、長期契約は、より良い条件での債務ファイナンス(融資)をしやすくします。資金調達の期間を契約期間に合わせることで、期間のミスマッチや価格変動リスクを効果的に下げられ、加えて多くの場合で、プロジェクトの内部収益率(IRR)が「十数パーセント」固定で確保されます。

さらに、超大規模クラウド事業者(Hyperscalers)も、この中で「保険(バックストップ)側」としての役割を果たすことがよくあります。彼らは直接の買い手として Neocloud から計算能力を調達し、それをAIラボへ転売します。こうした構造は関係者全員にとってウィンウィンです。Neocloudは、AAA格付けの承購方(引受側)に基づいてより良いファイナンス条件を得られます。一方で超大規模クラウド事業者は、自身のバランスシートを拡張せずに、信用補完を提供することでプロジェクト収益の一部を取り分けられます。

下表は、私たちが追跡しているいくつかの大規模一括販売(offtake)契約です。これらの取引について深掘り分析を行い、そこから逆算して、GPU時間単価($/hr/GPU)や、プロジェクトのIRR、EBIT利益率などの重要な収益指標の含意を推定します。

現時点の市場環境では、拡大している大型AIクラスタの大半は、実際にはAIラボの「社内消化(internal digestion)」によって取り込まれています。ただし、これらの機関は4年以内の契約市場に追加の計算能力を補充するために参入し続け、既存の H100 と H200 クラスタを更新することで、間接的に供給が当該市場へ再流入するのを阻止しています。GB200 と GB300 の超大規模クラスタが段階的に稼働するにつれ、1〜3年物の契約市場における需給関係がどのように変化するか——それが次に重点的に観察すべき変数になるでしょう。

「ボールはどこへ転がるのか」(Where The Puck is Going)

現在最も注目されているのは、基礎的な現実と市場のセンチメントの間にある明確なズレです。供給が締まり、価格が上がるという、Neocloudにとっては本来追い風となるシグナル(利益率の拡張、資産の使用寿命の延長)は非常に明確ですが、公開市場は CoreWeave、Nebius、Iris Energy などの企業に対してますます悲観的になっており、株価は現時点でも過去6〜12か月のレンジの下限近くにとどまっています。

市場はなお「最終的には供給が過剰になり、計算能力が商品化する」という物語に支配されています。しかし、上記の変化は、投資家がGPUの長期価値に抱く懸念を実際には十分に和らげていません。とはいえ、前線の状況を見ると、供給が継続して逼迫し、価格決定権が強まっていることは、ほぼすべての計算能力が「需要によって吸収されている」状態を意味します。性能に差があっても、現在のような極端な逼迫環境では、供給は需要に追いつかないのです。

今後の3つの観察ポイント

GPUレンタル価格が高止まりを続けるのかを判断するには、次の3つの変数に注目できます。

1、GB300クラスタの拡張ペース(2026年)

新規の計算能力とtoken需要の相対的な速度が鍵です。供給は逼迫が緩むのか、それとも需要が供給を上回り続けるのか。それは、AIラボが4年以内市場に引き続き参加するかどうか、そして当該レンジの価格動向に直結します。

2、チップ不足がさらに悪化するか

TSMCのN3プロセスの稼働能力、HBM、DRAM、NANDなどの重要な工程のいずれかで、製造実行レベルの変動が起これば、供給はさらに締まる可能性があります。

3、AIラボの収益(ARR)とtoken消費の増加速度

AIの商業化と利用規模の拡大が、終端需要の強さを決めます。これが計算能力需要を駆動する中核変数です。

価格は一方向に上昇し、リターンもそれに連動して改善する

総合すると、比較的明確な結論はこうです。GPUレンタル価格が上がり続ける確率は、下落する確率よりも高いということです。

このプロセスには、明確な自己強化の性質があります。Neocloudが供給の逼迫と価格上昇を観測すると、より多くのハードウェアを前もって確保し、それによって市場供給をさらに圧縮し、価格上昇をさらに押し上げます。これは2023〜2024年のGPU不足サイクルと似ています。当時は供給逼迫がOEMの利益率拡張を促し、サーバー価格が大きく上昇しました(ただし、今回の市場は成熟度がより高いため、同じように完全に再現されるとは限りません)。

同時に、GPUレンタル価格が再び上昇することは、Neocloudの資本回収(ROIC)も改善します。

一方で、すでにデプロイされた資産の利益率が上がり

他方で、GPUの経済的な利用期間が延びることで、資本はより長い期間キャッシュフローを生み出せます。

誰が現在の最大の受益者か?

現在最も直接的に受益するのは、次の特徴を持つ計算能力提供者です。

·短いサイクルの契約が中心(すぐに再価格設定できる)

·大量のH100在庫設備を保有

·短期的に新規の増産能力が立ち上がる

短期レンタル構造のNeocloudは、旧契約をより早く解放し、より高い価格で再契約できるため、利益率の拡張を迅速に実現できます。同様に、次世代の計算能力を先回りでロックしている超大規模クラウド事業者(多年度契約)とNeocloudも、今後の周期で利益を得ることになります。

では問題は、今回本当に「違う」のかどうかです。

[原文リンク]

クリックして律動BlockBeatsの採用情報を確認

律動BlockBeats公式コミュニティに参加しましょう:

Telegram購読グループ:https://t.me/theblockbeats

Telegram交流グループ:https://t.me/BlockBeats_App

Twitter公式アカウント:https://twitter.com/BlockBeatsAsia