GateUser-8cf35330

لا يوجد محتوى حتى الآن

GateUser-8cf35330

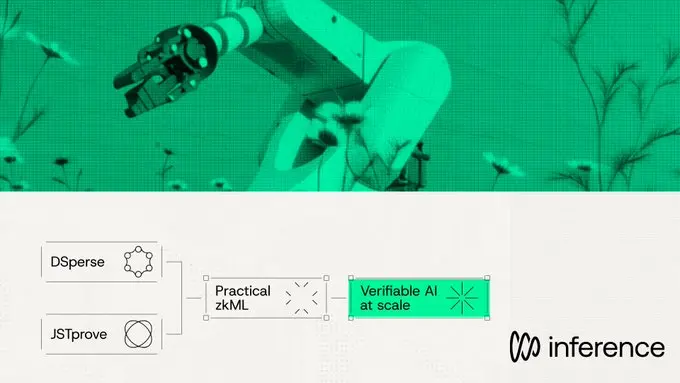

عندما بدأ الذكاء الاصطناعي في الدخول إلى أنظمة التنفيذ واتخاذ القرار على السلسلة، بدأت مشكلة تم تجاهلها لفترة طويلة في الظهور تدريجياً، وهي ما إذا كنا قادرين حقاً على التحقق مما إذا كانت مخرجات الذكاء الاصطناعي موثوقة، @inference_labs هي الفريق الذي يعمل على هذه القضية الحاسمة.

تتركز مختبرات الاستدلال على بناء بنية تحتية قابلة للتحقق من صحة استدلال الذكاء الاصطناعي، والاتجاه الرئيسي هو إدخال إثباتات المعرفة الصفرية في عملية استدلال الذكاء الاصطناعي، مما يمكّن الأنظمة على السلسلة من التحقق من صحة نتائج الاستدلال دون الكشف عن تفاصيل النموذج وبيانات الإدخال.

تظهر المعلومات التي كشفت عنها الشركة أ

شاهد النسخة الأصليةتتركز مختبرات الاستدلال على بناء بنية تحتية قابلة للتحقق من صحة استدلال الذكاء الاصطناعي، والاتجاه الرئيسي هو إدخال إثباتات المعرفة الصفرية في عملية استدلال الذكاء الاصطناعي، مما يمكّن الأنظمة على السلسلة من التحقق من صحة نتائج الاستدلال دون الكشف عن تفاصيل النموذج وبيانات الإدخال.

تظهر المعلومات التي كشفت عنها الشركة أ

- أعجبني

- إعجاب

- تعليق

- إعادة النشر

- مشاركة

تتحول اقتصاد المبدعين تدريجياً من نموذج اقتطاع المنصة إلى البناء المجتمعي، كيف يمكن أن يتحول التأثير الشخصي حقًا إلى أصول داخل السلسلة، أصبح سؤالاً يزداد واقعية، @Firestarter_AI هو من يقوم بحل هذه المشكلة.

تتمثل رؤية Firestarter في كونها منصة لإنشاء وتداول الرموز المخصصة للمبدعين والمجتمع، حيث يمكن لأي شخص إصدار رمزه الخاص دون الحاجة إلى إعدادات تقنية معقدة، والحصول مباشرة على سيولة تداول في السوق.

وفقًا للمعلومات الرسمية، فإن المنصة تجمع بين إصدار الرموز وتوجيه السيولة والتداول في نفس العملية، مما يقلل بشكل كبير من عائق دخول المبدعين إلى Web3.

يمكن للمؤيدين التعبير عن تأييدهم ليس فقط من خلال

شاهد النسخة الأصليةتتمثل رؤية Firestarter في كونها منصة لإنشاء وتداول الرموز المخصصة للمبدعين والمجتمع، حيث يمكن لأي شخص إصدار رمزه الخاص دون الحاجة إلى إعدادات تقنية معقدة، والحصول مباشرة على سيولة تداول في السوق.

وفقًا للمعلومات الرسمية، فإن المنصة تجمع بين إصدار الرموز وتوجيه السيولة والتداول في نفس العملية، مما يقلل بشكل كبير من عائق دخول المبدعين إلى Web3.

يمكن للمؤيدين التعبير عن تأييدهم ليس فقط من خلال

- أعجبني

- إعجاب

- تعليق

- إعادة النشر

- مشاركة

الكثير من الناس لا يزالون مهتمين بـ DeFi، لكنهم يترددون في المشاركة بسبب استراتيجيات معقدة، وتكاليف تعلم مرتفعة، وضغوط الإدارة اليدوية.

@River4fun اختيار الحل هو هذه النقطة المؤلمة الواقعية، حيث يتيح للمستخدمين الدخول بسهولة إلى عالم العوائد الهيكلية من خلال واجهة بسيطة وتنفيذ استراتيجيات تلقائية.

ستقوم خزينة Smart Vault الخاصة بـ River بتوزيع أصول المستخدمين تلقائيًا على الاستراتيجيات المقابلة، وإدارة التعرض ديناميكيًا بناءً على المؤشرات الموجودة على السلسلة.

تتم العملية بالكامل بواسطة العقود دون تدخل بشري، مع الاحتفاظ بسجلات تدقيق وتتبع كاملة. وهذا يجعل العوائد على السلسلة خيارًا مفهومًا ومو

@River4fun اختيار الحل هو هذه النقطة المؤلمة الواقعية، حيث يتيح للمستخدمين الدخول بسهولة إلى عالم العوائد الهيكلية من خلال واجهة بسيطة وتنفيذ استراتيجيات تلقائية.

ستقوم خزينة Smart Vault الخاصة بـ River بتوزيع أصول المستخدمين تلقائيًا على الاستراتيجيات المقابلة، وإدارة التعرض ديناميكيًا بناءً على المؤشرات الموجودة على السلسلة.

تتم العملية بالكامل بواسطة العقود دون تدخل بشري، مع الاحتفاظ بسجلات تدقيق وتتبع كاملة. وهذا يجعل العوائد على السلسلة خيارًا مفهومًا ومو

شاهد النسخة الأصلية

- أعجبني

- إعجاب

- تعليق

- إعادة النشر

- مشاركة

عندما تبدأ الأصول في العالم الحقيقي في أن تصبح ساحة المعركة الرئيسية للبلوكتشين، فإن ما إذا كانت البنية التحتية قد ولدت من أجل الأصول يصبح أمرًا بالغ الأهمية، @MavrykNetwork هو واحد من المشاريع القليلة الواقعية التي ظهرت في هذه العقدة.

Mavryk هو بلوكتشين من الطبقة الأولى يركز على توكينج الأصول الحقيقية، ويستهدف الأصول ذات القيمة العالية وقلة السيولة مثل العقارات.

المشروع ليس محصوراً في مرحلة المفهوم، بل قد أبرم شراكات مع العديد من المؤسسات لإدخال الأصول على البلوكتشين، مما يغطي أصولاً عقارية تتجاوز قيمتها عشرات المليارات من الدولارات.

تُحقق هذه الأصول من خلال الهيكل على البلوكتشين تقسيمًا، وتد

Mavryk هو بلوكتشين من الطبقة الأولى يركز على توكينج الأصول الحقيقية، ويستهدف الأصول ذات القيمة العالية وقلة السيولة مثل العقارات.

المشروع ليس محصوراً في مرحلة المفهوم، بل قد أبرم شراكات مع العديد من المؤسسات لإدخال الأصول على البلوكتشين، مما يغطي أصولاً عقارية تتجاوز قيمتها عشرات المليارات من الدولارات.

تُحقق هذه الأصول من خلال الهيكل على البلوكتشين تقسيمًا، وتد

MVRK-9.16%

- أعجبني

- إعجاب

- تعليق

- إعادة النشر

- مشاركة

مؤخراً، رأيت أن نشاط CodeXero في نظام Sei البيئي يتزايد تدريجياً، حيث أن定位 هذا المشروع ليس لإنشاء بروتوكولات مالية معقدة، بل يركز على أدوات البناء داخل السلسلة نفسها.

@codexero_xyz محرك البناء الموجه نحو التمويل اللامركزي، يعمل على Sei Network، ويؤكد على التجارب السريعة في بيئات عالية الأداء ومنخفضة التكلفة.

الهدف الأساسي لـ CodeXero هو تقليل العوائق أمام المستخدمين لإنشاء تطبيقات داخل السلسلة، مما يسمح لمزيد من المطورين غير التقليديين بالمشاركة في بناء منتجات Web3.

المشروع من خلال وسيلة تفاعلية بديهية، يوجه المستخدمين لإكمال نشر العقود الأساسية ومنطق التطبيقات، ويشبه أكثر مجموعة من الأدوات ال

@codexero_xyz محرك البناء الموجه نحو التمويل اللامركزي، يعمل على Sei Network، ويؤكد على التجارب السريعة في بيئات عالية الأداء ومنخفضة التكلفة.

الهدف الأساسي لـ CodeXero هو تقليل العوائق أمام المستخدمين لإنشاء تطبيقات داخل السلسلة، مما يسمح لمزيد من المطورين غير التقليديين بالمشاركة في بناء منتجات Web3.

المشروع من خلال وسيلة تفاعلية بديهية، يوجه المستخدمين لإكمال نشر العقود الأساسية ومنطق التطبيقات، ويشبه أكثر مجموعة من الأدوات ال

SEI1.44%

- أعجبني

- إعجاب

- تعليق

- إعادة النشر

- مشاركة

في عقدة تقاطع اتجاهات الذكاء الاصطناعي و Web3، تقوم @inference_labs ببناء فخ بنية تحتية موثوقة للتفكير للمستقبل.

الفريق من كندا، وقد أكمل في عام 2025 تمويلًا يقدر بحوالي 6.3 مليون دولار، وكان من بين المستثمرين DACM وDelphi Ventures وArche Capital وLvna Capital، حيث تم استخدام الأموال لبناء بروتوكولهم الأساسي Proof of Inference، وهو بروتوكول تشفير يعتمد على إثبات المعرفة الصفرية للتحقق من موثوقية نتائج استنتاجات الذكاء الاصطناعي دون الكشف عن التفاصيل الداخلية للنموذج.

تتمثل أهمية هذه التقنية في حل مشكلة الثقة التي كانت موجودة منذ فترة طويلة في مخرجات الذكاء الاصطناعي، من خلال إثبات رياضي يتيح ل

شاهد النسخة الأصليةالفريق من كندا، وقد أكمل في عام 2025 تمويلًا يقدر بحوالي 6.3 مليون دولار، وكان من بين المستثمرين DACM وDelphi Ventures وArche Capital وLvna Capital، حيث تم استخدام الأموال لبناء بروتوكولهم الأساسي Proof of Inference، وهو بروتوكول تشفير يعتمد على إثبات المعرفة الصفرية للتحقق من موثوقية نتائج استنتاجات الذكاء الاصطناعي دون الكشف عن التفاصيل الداخلية للنموذج.

تتمثل أهمية هذه التقنية في حل مشكلة الثقة التي كانت موجودة منذ فترة طويلة في مخرجات الذكاء الاصطناعي، من خلال إثبات رياضي يتيح ل

- أعجبني

- إعجاب

- تعليق

- إعادة النشر

- مشاركة

في ظل تزايد اقتصاد المبدعين نحو الاعتماد على السلسلة، يظل سؤال أساسي قائمًا: كيف يتم تحديد قيمة الأفراد بشكل مباشر واستمراريتها، بدلاً من أن تتأثر بخصم المنصات وخوارزميات الترتيب.

ظهور @Firestarter_fun جاء في هذا السياق ليقود مسارًا جديدًا تمامًا لتمكين الأصول على السلسلة.

حوله، تم تحويل إصدار الرموز من عمليات تقنية ومالية كثيفة إلى قدرة أساسية يمكن لأي فرد أو مجتمع المشاركة فيها.

من خلال Firestarter، يمكن للمبدعين إنشاء رموز خاصة بهم على شبكة Base بدون الحاجة للبرمجة، والدخول إلى سوق السيولة المدمج منذ البداية للتداول المستمر، دون الاعتماد على منصات مركزية أو عمليات خارجية.

آلية التوليد المدع

شاهد النسخة الأصليةظهور @Firestarter_fun جاء في هذا السياق ليقود مسارًا جديدًا تمامًا لتمكين الأصول على السلسلة.

حوله، تم تحويل إصدار الرموز من عمليات تقنية ومالية كثيفة إلى قدرة أساسية يمكن لأي فرد أو مجتمع المشاركة فيها.

من خلال Firestarter، يمكن للمبدعين إنشاء رموز خاصة بهم على شبكة Base بدون الحاجة للبرمجة، والدخول إلى سوق السيولة المدمج منذ البداية للتداول المستمر، دون الاعتماد على منصات مركزية أو عمليات خارجية.

آلية التوليد المدع

- أعجبني

- إعجاب

- تعليق

- إعادة النشر

- مشاركة

تقدم منصة Altura حلاً متعدد السلاسل وسوقًا بالعلامة البيضاء لتمكين فرق الألعاب من اتباع مسار تجاري أكثر استقرارًا، كما تتيح للمجتمع الحصول على صوت حقيقي داخل بيئته الخاصة.

يواجه العديد من فرق الألعاب نفس التساؤل عند دخول عالم Web3، وهو كيف يمكن جعل النظام الاقتصادي قابلاً للتوسع وعابرًا للسلاسل دون التضحية بتجربة اللعبة.

@alturax من البداية وضع أدوات ومرونة الاستخدام في المقام الأول، فهي تدعم النشر عبر سلاسل متعددة وتسمح للمشاريع بسرعة بناء متجر NFT خاص بها، مما يمكّن المجتمع من إتمام المعاملات والتواصل في بيئة مألوفة.

بالنسبة للمطورين، هذا يعني استقلالية أكبر، ومتطلبات تقنية أقل، كما يعني أنه

شاهد النسخة الأصليةيواجه العديد من فرق الألعاب نفس التساؤل عند دخول عالم Web3، وهو كيف يمكن جعل النظام الاقتصادي قابلاً للتوسع وعابرًا للسلاسل دون التضحية بتجربة اللعبة.

@alturax من البداية وضع أدوات ومرونة الاستخدام في المقام الأول، فهي تدعم النشر عبر سلاسل متعددة وتسمح للمشاريع بسرعة بناء متجر NFT خاص بها، مما يمكّن المجتمع من إتمام المعاملات والتواصل في بيئة مألوفة.

بالنسبة للمطورين، هذا يعني استقلالية أكبر، ومتطلبات تقنية أقل، كما يعني أنه

- أعجبني

- إعجاب

- تعليق

- إعادة النشر

- مشاركة

في ظل نضوج النظام البيئي اللامركزي تدريجيًا اليوم، قدمت CodeXero مسارًا أقل عتبة للمطورين والمبدعين لدخول عالم السلسلة.

@codexero_xyz مبني على شبكة Sei عالية الأداء، وهو منصة بناء تطبيقات لامركزية بدون رمز تعتمد على التعليمات، تتيح لأي شخص فقط باستخدام اللغة الطبيعية لوصف أفكاره أن يُنشئ بسرعة تطبيقات لامركزية قابلة للنشر على البلوكشين، ويمكنه أيضًا إنشاء رموز لهذه التطبيقات وإطلاق تجمعات السيولة.

هذا التصميم أزال الحاجة إلى كتابة ونشر العقود الذكية المعقدة في تطوير البلوكشين التقليدي، مما سمح لغير المطورين المحترفين بالمشاركة في بناء المنتجات المالية والألعاب والأدوات، وبالتالي دفع انتشار ودي

شاهد النسخة الأصلية@codexero_xyz مبني على شبكة Sei عالية الأداء، وهو منصة بناء تطبيقات لامركزية بدون رمز تعتمد على التعليمات، تتيح لأي شخص فقط باستخدام اللغة الطبيعية لوصف أفكاره أن يُنشئ بسرعة تطبيقات لامركزية قابلة للنشر على البلوكشين، ويمكنه أيضًا إنشاء رموز لهذه التطبيقات وإطلاق تجمعات السيولة.

هذا التصميم أزال الحاجة إلى كتابة ونشر العقود الذكية المعقدة في تطوير البلوكشين التقليدي، مما سمح لغير المطورين المحترفين بالمشاركة في بناء المنتجات المالية والألعاب والأدوات، وبالتالي دفع انتشار ودي

- أعجبني

- إعجاب

- تعليق

- إعادة النشر

- مشاركة

مع دخول نماذج الذكاء الاصطناعي على نطاق واسع إلى عمليات الإنتاج واتخاذ القرارات، أصبحت المصداقية والتحقق من الصحة التحديين الأساسيين للصناعة.

ظهر @inference_labs ليؤسس لنموذج جديد يضمن موثوقية مخرجات الذكاء الاصطناعي باستخدام طرق التشفير.

اقترح هذا المشروع وبنى نظام إثبات الاستنتاج، وهو بروتوكول يعتمد على إثبات المعرفة الصفرية، يمكن من خلاله تقديم إثباتات رياضية للتحقق من نتائج استنتاجات الذكاء الاصطناعي مع حماية خصوصية النموذج والبيانات.

هذه الآلية تعني أن مشغلي النماذج يمكنهم، مع الحفاظ على أمان حقوق الملكية الفكرية، إثبات صحة مخرجاتهم للجهات الخارجية، وهو أمر حاسم بشكل خاص للتطبيقات المؤسسي

شاهد النسخة الأصليةظهر @inference_labs ليؤسس لنموذج جديد يضمن موثوقية مخرجات الذكاء الاصطناعي باستخدام طرق التشفير.

اقترح هذا المشروع وبنى نظام إثبات الاستنتاج، وهو بروتوكول يعتمد على إثبات المعرفة الصفرية، يمكن من خلاله تقديم إثباتات رياضية للتحقق من نتائج استنتاجات الذكاء الاصطناعي مع حماية خصوصية النموذج والبيانات.

هذه الآلية تعني أن مشغلي النماذج يمكنهم، مع الحفاظ على أمان حقوق الملكية الفكرية، إثبات صحة مخرجاتهم للجهات الخارجية، وهو أمر حاسم بشكل خاص للتطبيقات المؤسسي

- أعجبني

- إعجاب

- تعليق

- إعادة النشر

- مشاركة