Como funciona a Dolphin Network? Análise detalhada do processo completo de inferência de IA descentralizado.

O desenvolvimento acelerado de modelos de IA está a impulsionar uma forte procura global de GPU. Com a expansão dos grandes modelos de linguagem (LLM), Agentes de IA e aplicações de automação, as plataformas de cloud de IA centralizada enfrentam custos elevados, concentração de recursos e desafios de escalabilidade. Neste cenário, as redes descentralizadas de GPU tornam-se uma direção estratégica para a infraestrutura de IA Web3.

A Dolphin Network surge como uma rede de inferência de IA criada para responder a esta tendência. O seu objetivo é reunir recursos de GPU distribuídos globalmente numa infraestrutura de IA aberta, coordenando programadores, nodos de GPU e a rede através do mecanismo de incentivos POD.

Qual é a estrutura central da Dolphin Network?

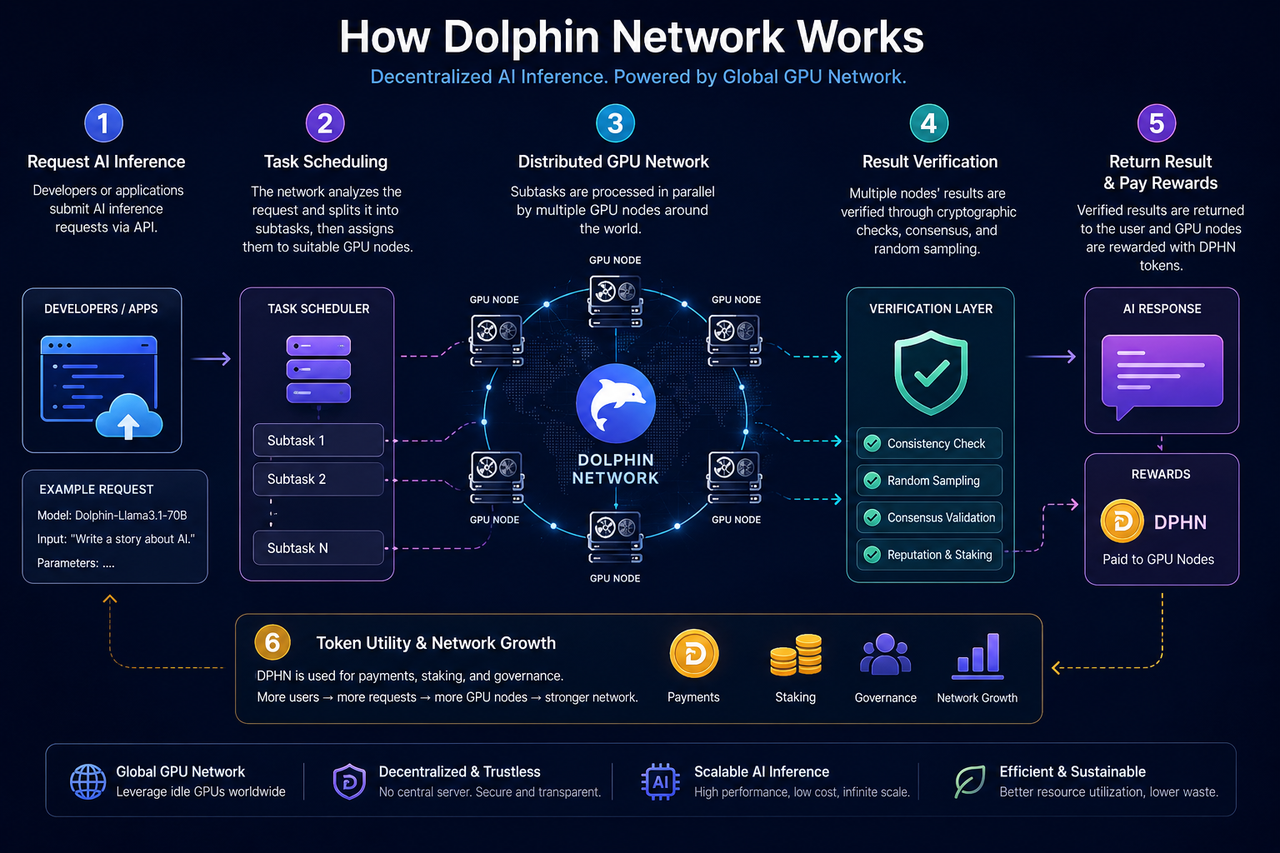

A arquitetura central da Dolphin Network integra três componentes: solicitantes de inferência de IA, a rede de nodos de GPU e um mecanismo de verificação e coordenação.

Programadores ou aplicações podem submeter pedidos de inferência de IA — como geração de texto, inferência de chat, invocação de modelos ou tarefas de Agente de IA — à rede. O sistema atribui os pedidos aos nodos mais adequados, tendo em conta o estado dos nodos de GPU, os requisitos das tarefas e a disponibilidade de recursos.

Os nodos de GPU são fornecidos por utilizadores de todo o mundo. Qualquer participante pode juntar-se à rede com GPUs inativas, executar tarefas de inferência localmente e receber recompensas em token segundo o seu contributo.

Para garantir a integridade dos resultados, a Dolphin utiliza mecanismos de verificação e incentivos económicos para coordenar o comportamento dos nodos, incluindo amostragem aleatória, revisão de tarefas e sistemas de staking.

Como entram os pedidos de inferência de IA na rede?

Quando um programador interage com a Dolphin Network, os pedidos são encaminhados para a camada de agendamento de tarefas.

Esta camada avalia o tipo de tarefa, requisitos de GPU e recursos de modelo. Diferentes modelos de IA podem exigir configurações de memória, velocidades de inferência e poder computacional distintos, pelo que a rede faz a correspondência dinâmica dos pedidos aos nodos conforme o seu estado.

Nas plataformas de cloud de IA centralizada, este processo é controlado por um único centro de dados. Na Dolphin, as tarefas são distribuídas por uma rede descentralizada de nodos de GPU.

Algumas tarefas podem ser divididas em vários pedidos de inferência menores para otimizar a eficiência e a concorrência da rede.

Como processam os nodos de GPU as tarefas de inferência de IA?

Os nodos de GPU constituem os principais recursos computacionais da Dolphin Network.

Os operadores de nodos instalam software específico e autorizam o sistema a utilizar as GPUs locais para tarefas de inferência de IA. Quando uma tarefa é atribuída, o nodo descarrega o modelo ou os parâmetros de inferência necessários e realiza o cálculo localmente.

Após a conclusão, o nodo envia os resultados de inferência à rede e aguarda a verificação para confirmar a validade dos resultados. Só as tarefas que passam na verificação são elegíveis para recompensas em token.

Este método distingue-se da mineração tradicional de GPU. Enquanto as redes PoW se centram em cálculos de hash, os nodos de GPU da Dolphin executam tarefas reais de inferência de IA, aproximando-se de um “mercado de poder de hash disponível”.

Como verifica a Dolphin os resultados de inferência de IA?

A inferência de IA difere das transações blockchain tradicionais, pois os resultados não podem ser validados por fórmulas matemáticas simples. Por isso, a Dolphin aplica mecanismos adicionais para impedir a submissão de resultados incorretos por parte dos nodos.

Uma abordagem comum é a amostragem aleatória — selecionar tarefas aleatoriamente para revisão e confirmar resultados consistentes entre vários nodos. A submissão persistente de dados anómalos pode reduzir a reputação de um nodo ou excluí-lo das recompensas.

Algumas redes descentralizadas de IA também recorrem ao staking. Os nodos devem fazer staking de tokens para participar, e ações maliciosas podem resultar em penalizações dos seus ativos em staking.

Estes incentivos económicos visam alinhar o comportamento dos nodos e reforçar a credibilidade da rede.

Como difere a Dolphin da inferência de IA em cloud tradicional?

As plataformas de cloud de IA tradicionais dependem de grandes centros de dados centralizados — entidades únicas controlam clusters de GPU, implementação de modelos e serviços API.

A Dolphin adota uma arquitetura de rede de GPU aberta. Os nodos de GPU são fornecidos por utilizadores globais, permitindo aos programadores aceder a serviços de inferência de IA num ambiente mais aberto e reduzindo a dependência de um único fornecedor.

A Dolphin valoriza modelos de IA abertos e partilha de recursos. Algumas redes suportam a implementação de modelos open-source, regras de sistema personalizadas e cenários abertos de Agente de IA.

No entanto, as redes de IA distribuída enfrentam desafios como estabilidade, latência de rede e variação na qualidade dos nodos, encontrando-se ainda nas fases iniciais de desenvolvimento.

Que desafios enfrenta a Dolphin Network?

As redes descentralizadas de inferência de IA promovem abertura e partilha de recursos, mas enfrentam desafios práticos significativos.

Em primeiro lugar, o desempenho dos nodos de GPU é muito variável. Diferenças em memória, largura de banda e capacidade de inferência afetam a estabilidade da rede.

Em segundo lugar, a verificação dos resultados de inferência de IA é complexa. Ao contrário das transações blockchain, os resultados de IA são probabilísticos, o que aumenta os custos de verificação.

Com o crescimento dos modelos de IA, o agendamento eficiente de clusters de GPU de grande escala em ambientes distribuídos torna-se um desafio central para projetos DePIN de IA.

A incerteza regulatória é igualmente relevante. Modelos de IA abertos podem suscitar questões relativas a dados, direitos de autor e geração de conteúdos, exigindo uma gestão rigorosa dos riscos regulatórios a longo prazo.

Resumo

A Dolphin Network é uma rede descentralizada de inferência de IA que combina IA e DePIN, construindo uma infraestrutura de IA aberta com nodos de GPU globais. A rede coordena programadores e nodos de GPU através do agendamento de tarefas, inferência distribuída, verificação aleatória e o mecanismo de incentivos DPHN.

Em comparação com plataformas centralizadas de cloud de IA, a Dolphin destaca-se pela abertura, partilha de recursos e resistência à censura, posicionando-se como referência para a infraestrutura de IA Web3.

Perguntas frequentes

Como utiliza a Dolphin os nodos de GPU?

Os titulares de GPU podem instalar nodos e disponibilizar recursos de GPU inativos para executar tarefas de inferência de IA e ganhar recompensas DPHN.

Quais são as etapas do processo de inferência de IA na Dolphin?

As principais fases são submissão de tarefas, agendamento de nodos, execução de inferência em GPU, verificação de resultados e distribuição de recompensas.

Porque é a Dolphin considerada um projeto DePIN?

Os recursos centrais são hardware de GPU real, coordenando infraestrutura distribuída via incentivos baseados em token.

Como difere a Dolphin das plataformas de cloud de IA tradicionais?

As plataformas de cloud de IA tradicionais dependem de centros de dados centralizados; a Dolphin utiliza uma rede de GPU aberta para fornecer serviços de inferência de IA distribuída.

Qual é o papel do DPHN na rede?

O DPHN serve para pagamentos de inferência de IA, recompensas de nodos, staking e incentivos económicos dentro da rede.

Artigos relacionados

Modelo Económico do Token ONDO: De que forma impulsiona o crescimento da plataforma e o envolvimento dos utilizadores?

Tokenomics da Morpho: Utilidade, distribuição e proposta de valor do MORPHO

Morpho vs. Aave: Análise aprofundada das diferenças de mecanismo e estrutura nos protocolos de empréstimos DeFi

Tokenomics do USD.AI: análise aprofundada dos casos de utilização do token CHIP e dos mecanismos de incentivos

Análise das Fontes de ganhos de USD.AI: como os empréstimos de infraestrutura de IA geram retorno