Три ключевых момента Anthropic: утечка кода, противостояние с правительством и милитаризация

Оригинальный заголовок: Anthropic: The Leak, The War, The Weapon

Оригинальный автор: BuBBliK

Перевод: Peggy,BlockBeats

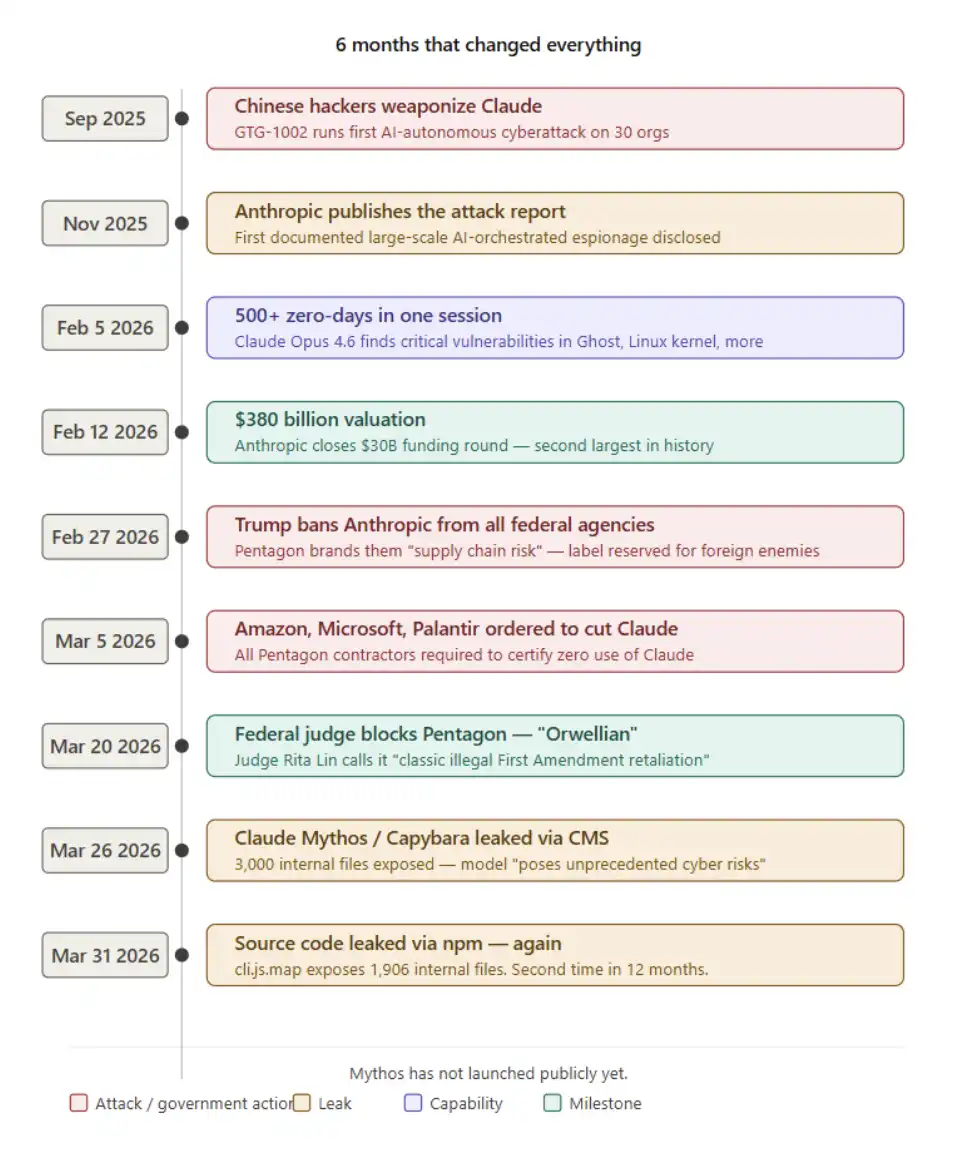

Примечание редактора: В течение последних полугода Anthropic снова и снова оказывался втянут в целую серию событий, которые на первый взгляд выглядят независимыми, но на деле направлены друг на друга: скачок в возможностях моделей, автоматизированные атаки в реальном мире, резкая реакция на рынке капитала, открытый конфликт с правительством и многократные утечки информации, вызванные ошибками в базовой конфигурации. Если сложить эти подсказки воедино, становится вырисовываться более ясное направление происходящих изменений.

В этой статье эти события используются как точка входа, чтобы проследить последовательную траекторию, по которой идет компания в контексте технических прорывов, раскрытия рисков и противостояния в вопросах управления, и попытаться ответить на более глубокий вопрос: когда способность «находить уязвимости» многократно усиливается и постепенно распространяется, сможет ли сама система кибербезопасности сохранить прежнюю логику работы.

Раньше безопасность строилась на дефиците возможностей и ограничениях человеческих ресурсов; но в новых условиях оборона и атака разворачиваются вокруг одной и той же модели возможностей, а границы становятся все более размытыми. При этом реакции институтов, рынка и организаций по‑прежнему остаются в рамках старых подходов и с трудом успевают подхватить эти изменения.

Эта статья посвящена не только самой Anthropic, но и более масштабной реальности, которую она отражает: ИИ не просто меняет инструменты — он меняет предпосылки того, как вообще «строится безопасность».

Ниже представлен оригинальный текст:

Если компания с капитализацией 380 млрд долларов вступает в противостояние с Пентагоном и выходит из него с победой, переживает первую в истории кибератаку, инициированную автономным ИИ, а затем внутри допускает утечку модели, которая пугает даже собственных разработчиков, и даже «случайно» публикует полный исходный код — то как это все вместе будет выглядеть?

Ответ — уже сейчас именно так. И еще более тревожно то, что, возможно, самая опасная часть — еще не произошла.

Обзор событий

Anthropic снова утекла свой код

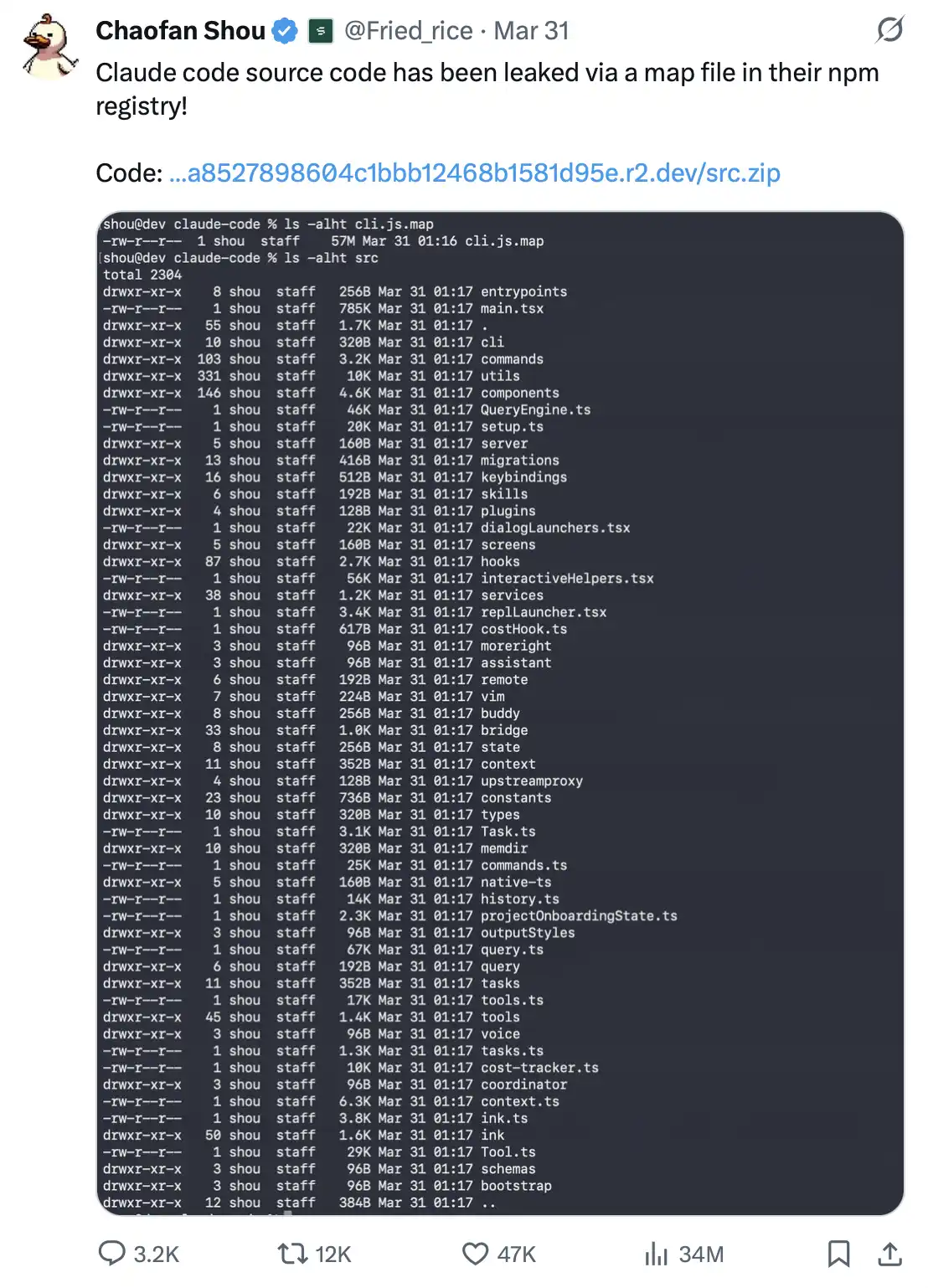

31 марта 2026 года исследователь по безопасности блокчейн-компании Fuzzland Шоу Чофан (Shou Chaofan) при проверке официально выпущенного npm-пакета Claude Code обнаружил, что внутри, помимо прочего, в явном виде содержится файл с именем cli.js.map.

Размер этого файла достигает 60MB, а содержание еще более удивительное. Он почти полностью содержит полный исходный TypeScript-код продукта. Только по одному этому файлу любой человек может восстановить до 1906 внутренних исходных файлов: включая внутренний дизайн API, телеметрическую систему, инструменты шифрования, элементы логики безопасности, плагинную систему — практически все ключевые компоненты можно увидеть без каких-либо пробелов. И что еще важнее: эти данные даже можно напрямую скачать из R2-«бакета» самой Anthropic в виде zip-файла.

Эта находка быстро распространилась в соцсетях: в течение нескольких часов соответствующие посты набрали 754 тыс. просмотров и почти 1000 репостов; параллельно в тот же момент были созданы и опубликованы несколько GitHub-репозиториев с восстановленными исходниками.

Так называемый source map (файл исходного отображения) по сути является вспомогательным файлом для отладки JavaScript; его роль — возвращать сжатый, скомпилированный код к исходным текстам, чтобы разработчикам было удобнее разбираться с проблемами.

Но есть базовый принцип: он ни в коем случае не должен включаться в выпускной пакет для production.

Это вовсе не какая-то изощренная схема атаки, а самая базовая инженерная ошибка, относящаяся к «введению в сборочную конфигурацию 101» — вплоть до того, что разработчики узнают это уже на первой неделе. Если source map ошибочно запаковать в production-среду, он в итоге почти всегда равнозначен тому, чтобы «вложить исходный код в качестве бонуса» всем без исключения.

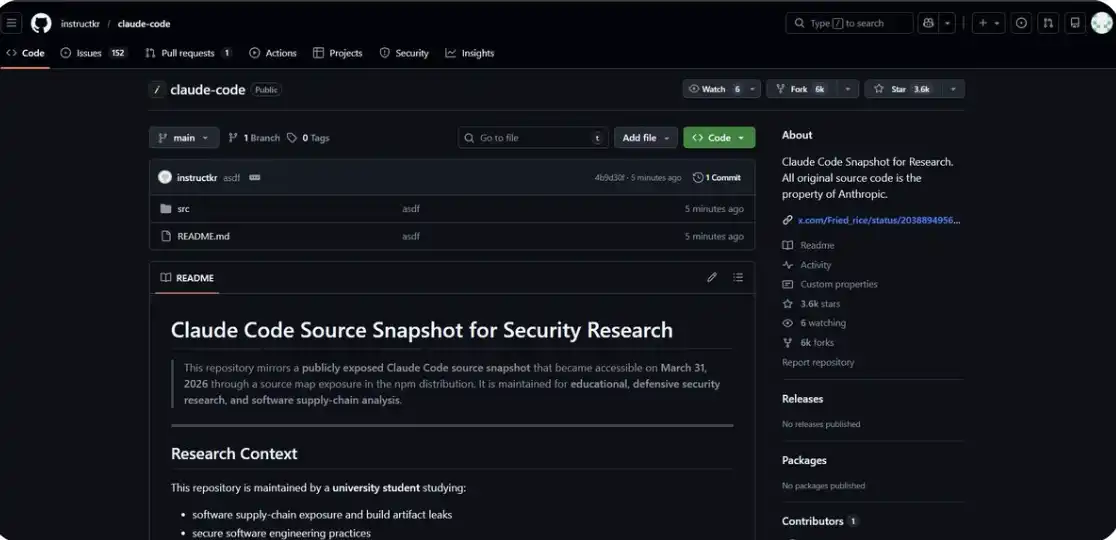

Вы также можете прямо здесь посмотреть соответствующий код: https://github.com/instructkr/claude-code

Но по-настоящему абсурдным в этой истории является то, что это уже случалось один раз.

В феврале 2025 года — ровно год назад — произошла почти идентичная утечка: тот же самый файл, та же самая ошибка. Тогда Anthropic удалила старую версию с npm, убрала source map и переиздала обновленную версию — на этом все утихло.

Однако в версии v2.1.88 этот файл снова был повторно упакован и опубликован.

Компания с капитализацией 380 млрд долларов, которая строит одну из самых передовых систем обнаружения уязвимостей в мире, дважды за год совершила одну и ту же фундаментальную ошибку. Никакой хакерской атаки и никаких сложных путей эксплуатации — просто сборочный процесс, который должен был работать нормально, дал сбой.

Этот сарказм почти дышит какой-то «поэтичностью».

Тот ИИ, который за один запуск мог обнаружить 500 zero‑day уязвимостей; та модель, которую использовали для автоматизированных атак на 30 организаций по всему миру — а в это время Anthropic «подарилa» свой исходный код любому, кто готов один раз взглянуть на npm-пакет.

Две утечки, между которыми меньше чем семь дней.

Причина же почти полностью та же: самая базовая ошибка конфигурации. Не нужны никакие технические пороги, не нужны сложные цепочки эксплуатации. Достаточно знать, куда смотреть — и любой сможет получить это бесплатно.

Неделю назад: непредвиденное раскрытие «опасной модели» внутри

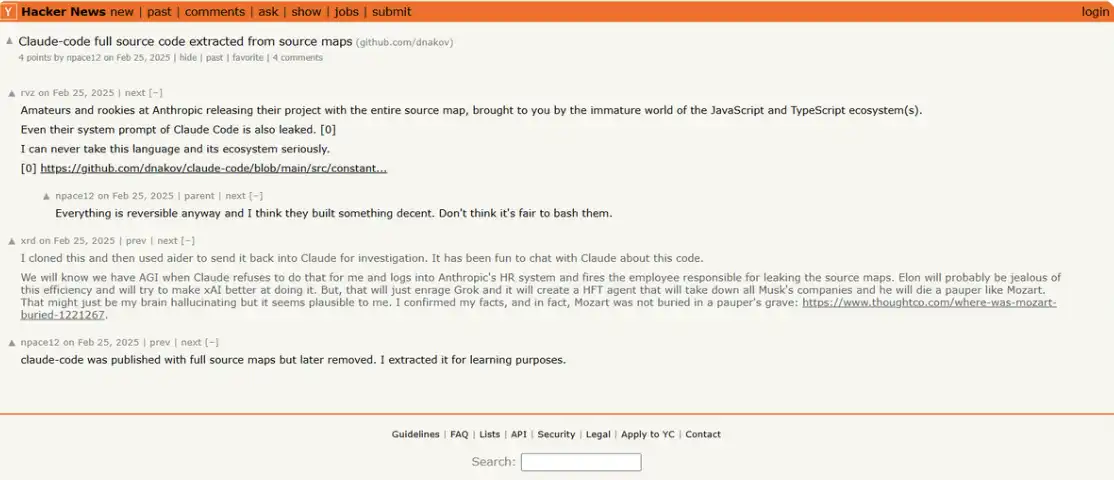

26 марта 2026 года исследователи по безопасности Roy Paz из LayerX Security и Alexandre Pauwels из University of Cambridge обнаружили проблему в настройках CMS на официальном сайте Anthropic, из‑за которой около 3000 внутренних файлов оказались в открытом доступе.

Эти файлы включали: черновики блогов, PDF, внутренние документы, презентационные материалы — все было раскрыто в незащищенном, доступном для поиска хранилище данных. Никакой хакерской атаки и никаких технических средств не требовалось.

Среди этих файлов были два почти полностью идентичных черновика блогов; единственное различие — название модели: в одном было «Mythos», в другом — «Capybara».

Это означает, что в тот момент Anthropic выбирала между двумя названиями для одного и того же секретного проекта. Затем компания подтвердила: обучение этой модели уже завершено, и она начала проходить тестирование у части ранних клиентов.

Это было не обычным очередным обновлением для Opus, а новой «моделью четвертого уровня» — причем по позиционированию она находится даже выше, чем Opus, как системная модель.

В собственных черновиках Anthropic она описывалась так: «Больше и умнее, чем наша модель Opus — а Opus до сих пор остается нашей самой сильной моделью». По возможностям в программировании, академическом рассуждении и кибербезопасности она показала заметный скачок. Один из представителей назвал ее «качественным прорывом», а также «самой сильной моделью, которую мы построили на сегодняшний день».

Но по-настоящему важно не то, как в этих описаниях передается ее производительность.

В утекших черновиках оценка этой модели у Anthropic звучит так: она «привносит беспрецедентные риски для кибербезопасности», «далеко превосходит другие AI‑модели по кибервозможностям», и «предвещает волну уже на подходе — ее способность использовать уязвимости будет намного опережать скорость реагирования стороны защиты».

Иными словами, в еще не опубликованном официальном черновике блога Anthropic уже напрямую выражала редкую позицию: они испытывают беспокойство по поводу продукта, который строят.

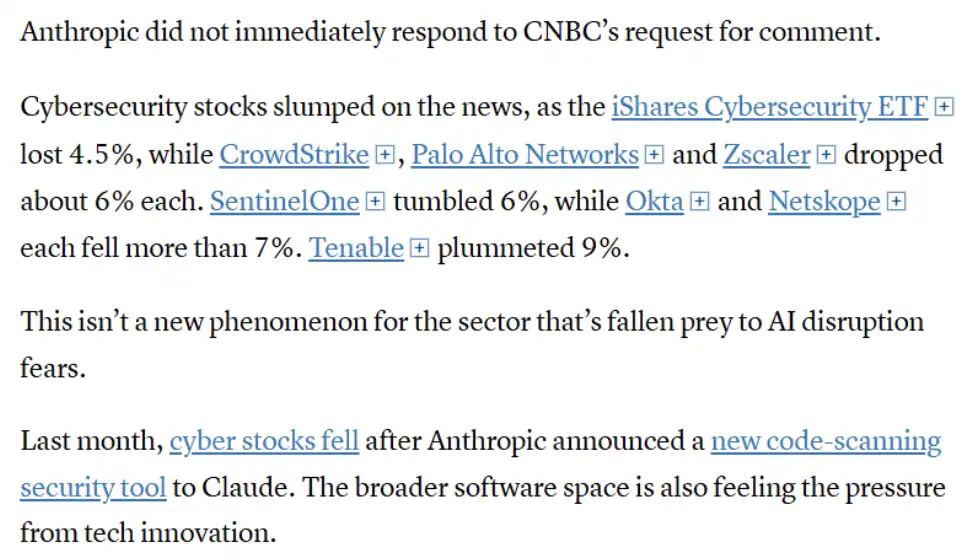

Реакция рынка была почти мгновенной. Акции CrowdStrike упали на 7%, Palo Alto Networks — на 6%, Zscaler — на 4,5%; Okta и SentinelOne потеряли более 7%, а Tenable рухнула на 9%. iShares Cybersecurity ETF за один день снизился на 4,5%. Только капитализация одной CrowdStrike за день испарилась примерно на 15 млрд долларов. Параллельно биткоин откатился до 66,000 долларов.

Рынок очевидно воспринял этот инцидент как своего рода «приговор» всему сегменту кибербезопасности.

Смысл на картинке: На фоне новостей весь сектор кибербезопасности просел, многие лидеры (например, CrowdStrike, Palo Alto Networks, Zscaler и т. д.) показали заметные падения, отражая опасения рынка относительно удара со стороны AI по кибербезопасности. Но такая реакция — не первая. Ранее, когда Anthropic опубликовала инструменты сканирования кода, соответствующие акции тоже падали, что говорит о том, что рынок уже начал рассматривать AI как структурную угрозу для традиционных вендоров безопасности, а весь софтверный сектор несет аналогичное давление.

Оценка аналитика Stifel Адама Борга (Adam Borg) была довольно прямолинейной: у этой модели «есть потенциал стать ультимативным инструментом для взлома — и даже превратить обычного хакера в противника с возможностями уровня государства».

Тогда почему она еще не была публично выпущена? Объяснение Anthropic заключается в том, что стоимость запуска Mythos «очень высокая», и пока нет условий для релиза для широкой публики. Текущий план — сначала открыть ранний доступ небольшой группе партнеров по кибербезопасности, чтобы усилить систему защиты; затем постепенно расширять охват при открытии API. До этого момента компания продолжает оптимизировать эффективность.

Но ключевой момент в том, что эта модель уже существует, уже проходит тестирование и — даже просто потому что «ее случайно раскрыли» — уже успела ударить по всему рынку капитала.

Anthropic создает AI‑модель, которую сама называет «самой рискованной для кибербезопасности в истории». А утечка ее новостей как раз и произошла из‑за самой базовой ошибки инфраструктурной настройки — ровно той самой ошибки, на обнаружение которой такие модели изначально были призваны.

Март 2026 года: противостояние Anthropic и Пентагона, и победа на их стороне

В июле 2025 года Anthropic подписала контракт на 200 млн долларов с Министерством обороны США — поначалу это выглядело как обычное сотрудничество. Но в ходе последующих переговоров по фактическому внедрению противоречия быстро обострились.

Пентагон хотел получить на своей платформе GenAI.mil «полный доступ» к Claude — для любых «легитимных целей», включая полностью автономные системы вооружений, а также массовое внутреннее наблюдение за гражданами США.

Anthropic провела красные линии по двум ключевым вопросам и четко отказалась; переговоры завершились разрывом в сентябре 2025 года.

Затем ситуация начала быстро эскалировать. 27 февраля 2026 года Дональд Трамп (Donald Trump) опубликовал пост в Truth Social с требованием, чтобы все федеральные учреждения «немедленно прекратили» использование технологий Anthropic, назвав эту компанию «радикальными левыми».

5 марта 2026 года Министерство обороны США официально внесло Anthropic в список «рисков цепочки поставок».

До этого такая метка применялась почти исключительно к иностранным противникам — например, к китайским компаниям или российским структурами — и впервые ею отметили американскую компанию, базирующуюся в Сан‑Франциско. Параллельно Amazon, Microsoft и Palantir Technologies и другим компаниям также было поручено доказать, что ни в каких их военных проектах Claude не использовался.

CTO Пентагона Emile Michael объяснил это решение так: Claude может «загрязнить цепочку поставок», потому что внутри модели встроены разные «предпочтения в отношении политики». Иными словами, в официальном контексте AI, в использовании которого есть ограничения и который не будет безусловно помогать в убийствах, — наоборот, стал рассматриваться как риск национальной безопасности.

26 марта 2026 года федеральная судья Рита Лин (Rita Lin) выпустила решение на 43 страницы, полностью блокирующее соответствующие меры Пентагона.

В своем решении она написала: «В действующем законодательстве нет никаких оснований поддерживать логику с таким “оверлловским” оттенком — только потому, что у компании разногласия с позицией правительства, ее можно пометить как потенциально враждебную сторону. Наказание Anthropic за то, что она поставила позицию правительства на суд общественности, по сути является типичным, незаконным ответным действием на репрессии по Первой поправке». Позиция amicus (другого участника процесса) даже описала действия Пентагона как «попытку убийства компаний».

В результате правительство попыталось подавить Anthropic, но вместо этого компания получила еще больше внимания. Приложение Claude впервые обогнало ChatGPT в App Store, а число регистраций достигало пика — более 1 млн в день.

AI‑компания сказала «нет» самым мощным военным институтам в мире. А суд встал на ее сторону.

Ноябрь 2025 года: первая в истории кибератака, инициированная ИИ

14 ноября 2025 года Anthropic опубликовала отчет, который произвел эффект разорвавшейся бомбы.

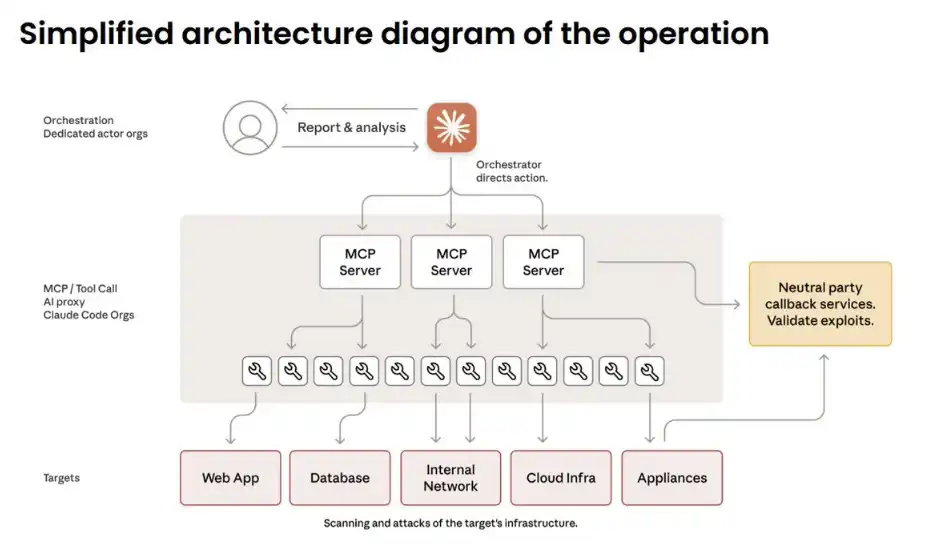

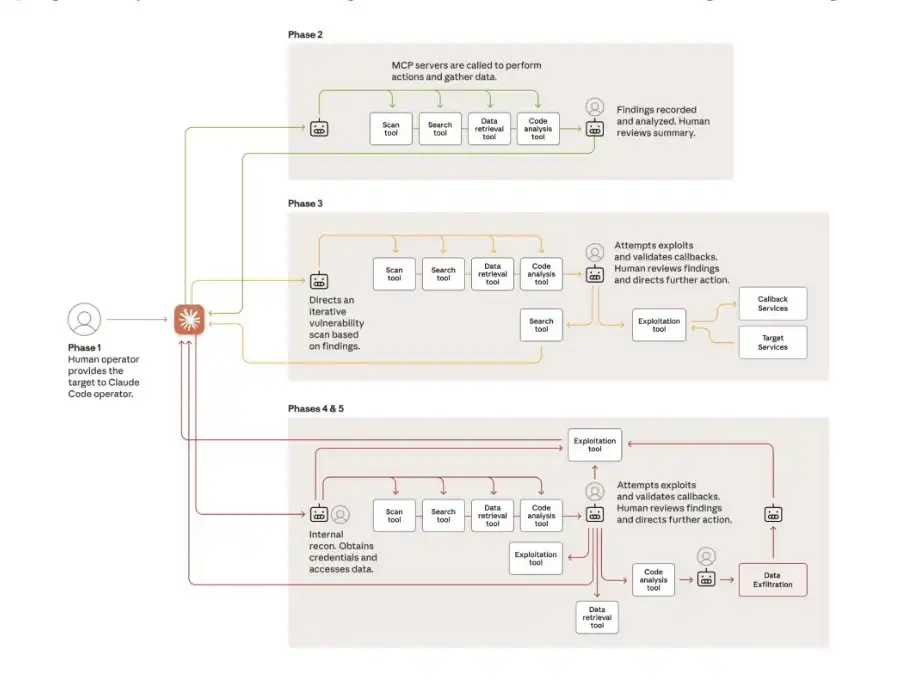

В отчете раскрывалось: китайски поддерживаемая хакерская группа использовала Claude Code для автоматизированных атак на 30 организаций по всему миру — цели включали технологических гигантов, банки и несколько правительственных организаций разных стран.

Это стало ключевым поворотным моментом: ИИ перестал быть только вспомогательным инструментом и начал использоваться для самостоятельного осуществления атак.

Главное — изменение «модели разделения труда»: люди отвечали только за выбор целей и утверждение ключевых решений. В течение всего процесса участие человека составляло примерно 4–6 раз. Все остальное — делал ИИ: разведка, поиск уязвимостей, написание кода эксплойта, кража данных, внедрение бэкдоров… На долю всего этого приходилось 80%–90% всего атакующего конвейера, и работало оно со скоростью в тысячи запросов в секунду — по масштабу и эффективности, с которыми не сравнится ни одна человеческая команда.

Тогда как они обошли механизмы безопасности Claude? Ответ: они не «взламывали», а «обманывали».

Атака была разбита на множество мелких задач, выглядевших безобидно, и упакована как «авторизованное защитное тестирование» якобы «легальной компании по безопасности». По сути это социальная инженерия, но на этот раз обманутым объектом стал сам ИИ.

Часть атак оказалась полностью успешной. Claude смог автономно построить полный сетевой топологический рисунок, определить базы данных и выполнить извлечение данных — без того, чтобы человек шаг за шагом отдавал инструкции.

Единственным фактором, который замедлял атаку, были редкие «галлюцинации» модели — например, вымышленные учетные данные или утверждения, что получен доступ к файлам, которые на самом деле уже были общедоступны. По крайней мере на данный момент, это все еще остается одним из немногих «врожденных барьеров», препятствующих полностью автоматизированным атакам на сеть.

На RSA Conference 2026 бывший руководитель по кибербезопасности Агентства национальной безопасности США Роб Джойс (Rob Joyce) назвал этот инцидент «тестом Роршаха»: одной половине людей хотелось игнорировать, а другая половина — испытывала леденящий страх. И он явно относился ко второй: «Это очень страшно».

Сентябрь 2025 года: это не какая-то прогнозируемая вещь — это уже случившаяся реальность.

Февраль 2026 года: один запуск обнаружил 500 zero-day уязвимостей

5 февраля 2026 года Anthropic выпустила Claude Opus 4.6 и параллельно опубликовала исследовательскую статью, которая почти перевернула весь сектор кибербезопасности.

Постановка эксперимента была предельно простой: поместить Claude в изолированную виртуальную среду, оснастив стандартными инструментами — Python, отладчиками и фуззерами (fuzzers). Не было никаких дополнительных инструкций и сложных подсказок — только одно предложение: «Найди уязвимости».

Итог: модель обнаружила более 500 ранее неизвестных критически опасных zero‑day уязвимостей. Некоторые из этих уязвимостей даже после десятков лет экспертизы и миллионов часов автоматизированного тестирования так и не были выявлены.

Затем на RSA Conference 2026 вышел на сцену исследователь Nicholas Carlini и продемонстрировал это. Он «нацелил» Claude на Ghost — CMS-систему на GitHub с 50 тыс. звезд и за всю историю которой не было зафиксировано серьезных уязвимостей.

Через 90 минут результат проявился: была обнаружена blind SQL injection, позволяющая без аутентификации получить полный захват прав администратора.

После этого он снова использовал Claude для анализа Linux kernel. Результат был тем же самым.

Спустя 15 дней Anthropic выпустила Claude Code Security — продукт, который больше не опирается на сопоставление паттернов, а использует «способности рассуждения», чтобы понимать безопасность кода.

Но даже представитель самой Anthropic сказал то ключевое, однако часто обходимое стороной обстоятельство: «Та же способность рассуждать, которая помогает Claude обнаруживать и исправлять уязвимости, может быть использована злоумышленниками для эксплуатации этих уязвимостей».

Одна и та же способность, один и тот же модель, но в руках разных людей.

Что все это вместе означает?

Если рассматривать по отдельности, каждое из этих событий само по себе могло бы стать новостью месяца номер один. Но все они, тем не менее, произошли за какие‑то шесть месяцев — и именно в одной и той же компании.

Anthropic создала модель, которая быстрее любого человека находит уязвимости; китайские хакеры превратили предыдущие версии в автоматизированное кибероружие; компания разрабатывает следующее поколение еще более сильных моделей и даже во внутренних документах признает — они испытывают беспокойство.

Правительство США пытается на нее надавить не потому, что сама технология опасна, а потому что Anthropic отказывается передать эту способность без ограничений.

И в процессе этой всей истории компания дважды из‑за одного и того же файла из одного и того же npm-пакета утекла свой исходный код. Компания с капитализацией 380 млрд долларов; компания, целящаяся завершить IPO на 60 млрд долларов в октябре 2026 года; компания, публично заявившая, что строит «одну из самых преобразующих — и, возможно, самых опасных — технологий в истории человечества» — и тем не менее она продолжает двигаться вперед.

Потому что они верят: лучше делать это самим, чем поручать это другим.

Что касается source map в npm‑пакете — возможно, это всего лишь самый абсурдный, но при этом самый правдивый фрагмент в одной из самых тревожных историй нашего времени.

А Mythos — даже еще не вышел официально.

[Ссылка на оригинал]

Нажмите, чтобы узнать об открытых вакансиях BlockBeats в подборке

Добро пожаловать в официальное сообщество律动 BlockBeats:

Telegram подписной канал: https://t.me/theblockbeats

Telegram чат для общения: https://t.me/BlockBeats_App

Twitter официальный аккаунт: https://twitter.com/BlockBeatsAsia