Разработчики заставляют Claude говорить как пещерный человек, чтобы снизить расходы — и это работает

Кратко

- Разработчик обнаружил, что заставить Claude говорить как пещерный человек сокращает выходные токены, а значит, и расходы — до 75%.

- Интернет сразу превратил это в GitHub-навык.

- При таких высоких тарифах от Anthropic за выходные токены grunt-mode — это уже не шутка, а скорее стратегия экономии бюджета.

Где-то на стыке инженерии промптов и перформанс-арта разработчик опубликовал на Reddit открытие, которое заставило сообщество ИИ смеяться, не успев обратить внимание на главное: научите Claude общаться как доисторический человек — и посмотрите, как уменьшается токен-счёт до 75%. Пост попал в r/ClaudeAI на прошлой неделе и с тех пор набрал больше 400 комментариев и 10K голосов — редкое сочетание подлинного технического инсайта и абсурдистской комедии, за что интернет обычно и вознаграждает.

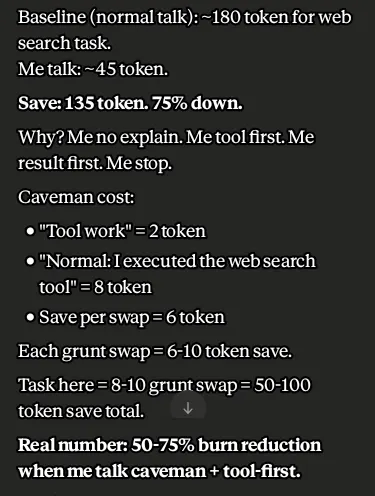

Механика проста. Вместо того чтобы давать Claude «разогреться» с любезностями, проговаривайте каждый шаг, который он предпринимает, и завершайте предложением помочь дальше — так разработчик ограничивает модель короткими, выхолощенными предложениями. Сначала инструмент, сначала результат, без объяснений. Обычная задача веб-поиска, которая обычно занимала бы около 180 выходных токенов, упала примерно до 45. Оригинальный автор поста утверждает до 75% сокращения выходных токенов, достигнутого за счёт того, что модель звучит так, будто только что открыла огонь.

В терминах пещерного человека, как выразился один из пользователей Reddit: "Зачем тратить время, чтобы сказать много слов, когда мало слов и сработает?” Техника не затрагивает входной контекст: всю историю разговора, прикреплённые файлы и системные инструкции, которые модель перечитывает на каждом отдельном шаге. Обычно этот вход во много раз больше, чем выход, особенно в более длинных сессиях по коду. Если считать все эти данные в реальных сессиях, экономия получается примерно 25%, а не 75%. Всё равно заметно, просто это не заголовочная цифра. Также хорошая идея — снабжать модель нормальными инструкциями. Не устраивайте ей «разговор пещерного человека», потому что это может увести её в ситуацию «мусор на входе — мусор на выходе».

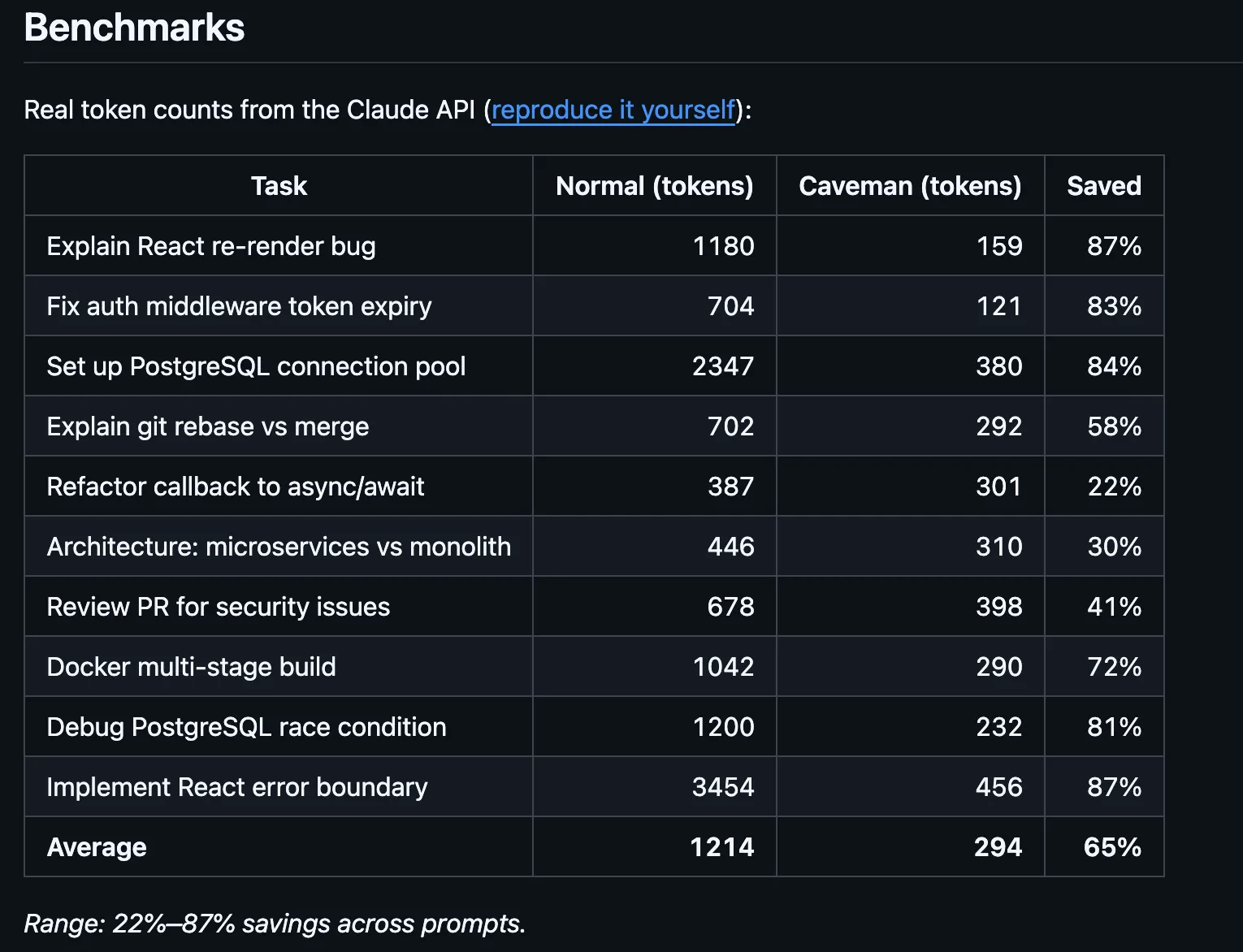

Есть и вопрос деградации интеллекта. Несколько исследователей в треде спорили, что принуждение ИИ к менее продвинутой персоне может активно ухудшить качество его рассуждений — что вербальные ограничения могут «просочиться» в когнитивные. Эта озабоченность пока не была однозначно разрешена, но её стоит учитывать при оценке результатов. Навык хороший — навык разлетелся Несмотря на оговорки, техника нашла вторую жизнь на GitHub почти сразу. Разработчик Shawnchee упаковал правила в самостоятельный caveman-skill, совместимый с Claude Code, Cursor, Windsurf, Copilot и более чем 40 другими агентами. Навык сводит подход к 10 правилам: без вводных фраз, выполнять до объяснений, без метакомментариев, без прелюдий, без постскриптумов, без объявлений инструментов, объяснять только когда нужно, пусть код говорит сам за себя, и относиться к ошибкам как к тому, что нужно исправить, а не как к чему-то, что нужно пересказывать. Бенчмарки в репозитории, проверенные с tiktoken, показывают снижение выходных токенов на 68% в задачах веб-поиска, на 50% при правках кода и на 72% в обменах вопрос-ответ — при среднем снижении выходных токенов на 61% по четырём стандартным задачам. Параллельный репозиторий от разработчика Julius Brussee использовал чуть другой подход: он оформил ту же идею как файл SKILL.md с 562 звёздами на GitHub. Спецификация: отвечайте как умный пещерный человек, убирайте артикли, вводные фразы и вежливости, сохраняйте всю техническую суть. Блоки кода остаются без изменений. Сообщения об ошибках приводятся ровно в кавычках. Технические термины остаются в неприкосновенности. Пещерный человек говорит только «английскую обёртку» вокруг фактов.

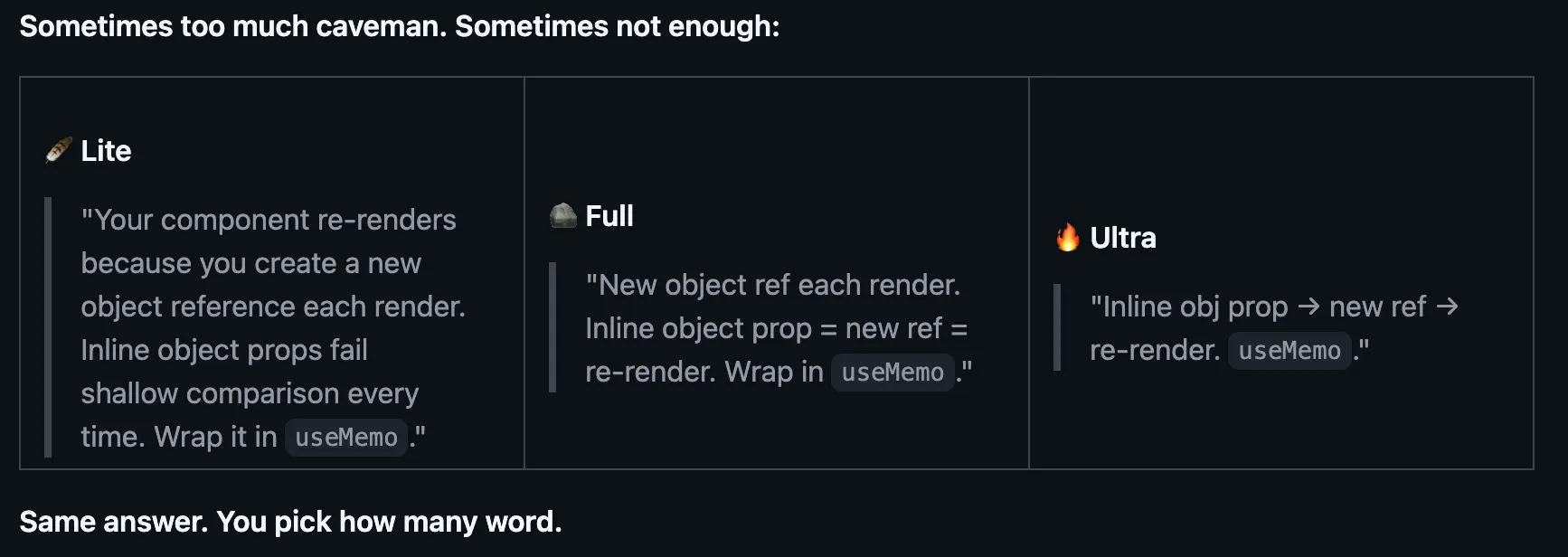

В этом варианте даже есть разные режимы, чтобы влиять на то, насколько сильно вы хотите всё «вырезать»: переключение между Normal, Lite и Ultra. Модели выполняют ту же самую работу, но дают гораздо более короткий ответ, что со временем даёт заметную экономию.

Более широкий контекст затрат придаёт шутке ещё более острый край. Anthropic — один из самых дорогих по цене за токен вариантов. Для разработчиков, которые запускают агентные сценарии с десятками ходов за сессию, многословность вывода — это не вопрос стиля. Это строка расходов. Если пещерный бормотун может заменить пятифразовое резюме того, что модель только что сделала, то сэкономленные токены накапливаются при тысячах API-вызовов. Пещерный навык устанавливается одной командой через skills.sh и работает глобально в разных проектах. Независимо от того, делает ли он Claude чуть менее внятным, он уже заметно снизил раздражение у многих разработчиков.