Claude Code електронний домашній улюбленець /buddy тихо вирвали! Розробник вилаявся, а потім навмисно «понизив версію»

Anthropic цього разу справді спалив доброзичливість спільноти? Функція Claude Code /buddy була лише вчора (4/8) повністю відкрита для користувачів Pro, а сьогодні після автоматичного оновлення до v2.1.97 вона повністю зникла: після цього вивід команд залишився лише один холодний і байдужий повідомлення про помилку «Unknown skill: buddy».

(Передісторія: Anthropic наробив вибух! Утечка 500 000 рядків важливого оригінального коду Claude Code: конкуренти можуть зробити реверсний інжиніринг, а нова модель Capybara підтверджує)

(Додатковий контекст: Anthropic заборонив у підписників Claude Code OpenClaw для лобстерів! Надалі сторонні інструменти можуть лише в межах платних лімітів)

Усе починається з 2026-03-31: через прогалину в налаштуваннях .npmignore Anthropic завантажив повний вихідний код Claude Code до npm (@anthropic-ai/claude-code v2.1.88), і за один раз витекло 512,000 рядків коду TypeScript, 1,900 файлів, разом 59.8 MB. Дослідник із кібербезпеки Chaofan Shou першим викопав ці дані, але справді змусило розробницьку спільноту закипіти — це випадковий великодній яєчний сюрприз, захований у середині.

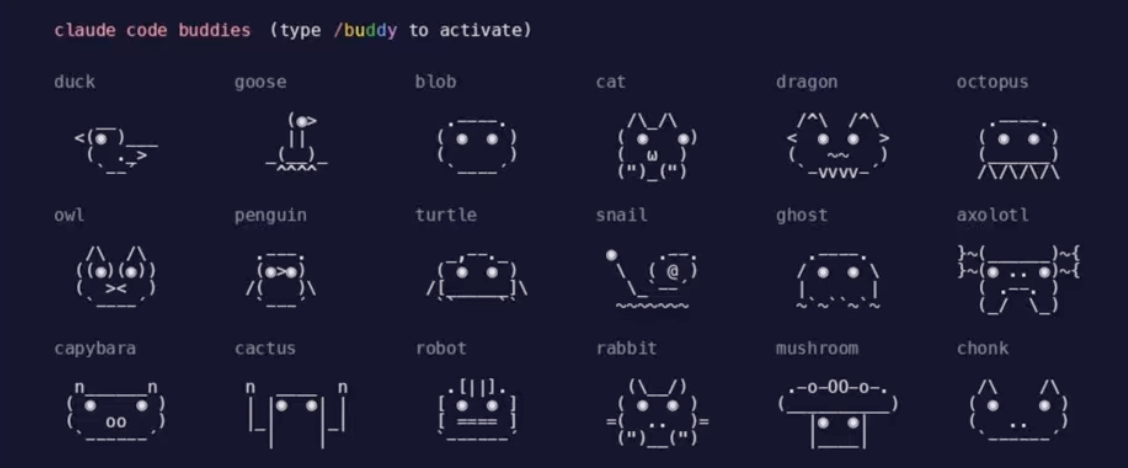

У витеклому коді є прихована функція /buddy: електронний вихованець, що живе поруч із полем введення в терміналі та реагує на ваші діалоги під час написання коду, схожий на електронну курку (сподіваюсь, молодь знає, що це таке) — з персонажами зсередини.

Коли Futurism повідомив про цей витік із сюрпризом, емоції розробників за 48 годин перевернулися з «Anthropic знову наробив проблем» на «holy shit, Anthropic що, таємно щось будує?»

18 видів, RPG-атрибути, AI-душа

Витік коду розкрив повний проєкт Buddy. 18 видів можна всиновити, зокрема duck, cat, rabbit, capybara (водяний вепр) аж до ghost, blob, mushroom; рідкість — від Common (60%) до Legendary (1%), і ще є 1% імовірності для блискучої варіації. У кожного Buddy є 5 RPG-атрибутів (оцінки від 0 до 100, зокрема CHAOS, SNARK тощо), а також використовується AI для створення окремої особистості «souls», яка реагує на ваші репліки.

Це не дуже схоже на створення CLI-інструмента; радше це робота, яка має характер, як партнер із настроєм. Розробницька спільнота сприймає це як відмінність «м’якої сили» Anthropic у протистоянні Cursor і GitHub Copilot: усі ті самі AI-помічники для написання коду, але лише Claude Code дозволяє вирощувати електронного вихованця.

Починаючи з v2.1.89, Anthropic офіційно надав /buddy користувачам Pro-підписки; 4/8 — повністю відкрили. Це фактично перетворило витрачений великодній сюрприз на офіційну функцію. Спільнота ще не встигла скласти список бажань (кастомний вигляд, підтримка VSCode, пам’ять між сесіями, sub-agent buddies), а оновлення v2.1.97 від 4/9 уже усе очистило.

Колективне відкочування розробників

Після виходу v2.1.97 на GitHub з’явилася петиція «Bring Back Buddy» (Issue #45596)幾小時內就湧入大量反應,同時還有 #45517 «/buddy command and companion completely missing in v2.1.97 (works in v2.1.96)» та #45525 «/buddy returns ‘Unknown skill: buddy’» й інші), де видно, що розробникам дуже потрібен електронний вихованець.

Ще рідкісніший випадок: хтось із розробників обрав вручну відкотитися назад до v2.1.96 лише заради того, щоб зберегти свого Buddy, якого він виростив. Хтось у спільноті написав: «Це не те, що роблять із функціями звичайних CLI-інструментів — люди таке не роблять».

За два дні також з’явилися сторонні хак-інструменти claude-code-buddy-reroll і any-buddy.

Оскільки сторінка офіційного changelog станом на час публікації повністю не згадувала про це вилучення, а Anthropic досі не зробив жодного оголошення, емоції спільноти виглядали не як звичайне невдоволення через функціональні зміни — радше як ніби комусь встромили ніж. Хтось прямо назвав це оновлення «знищенням доброзичливості спільноти без жодної користі».

Нову додаткову платну опцію Claude Code /fast відкрито швидше, ніж минулий звичайний режим; чи повернеться /buddy наступним кроком — поки що питання до офіційних відповідей.

Пов'язані статті

Forefront Tech завершує $100M зведення цін IPO, лістинг на Nasdaq за кодом FTHAU

Код Anthropic Claude завищив оплату користувачу на $200,98 через помилку в білінгу; спочатку відмовили у поверненні коштів, перш ніж повністю компенсувати збитки

DeepSeek 30 квітня представив метод Visual Primitives для покращення мультимодальних міркувань

NVIDIA випустила ваги флагманської моделі Cosmos-Reason2-32B і розширила контекстне вікно до 256K токенів

OpenAI пояснює, чому Codex забороняє згадувати «ґоблінів»: винагорода за «ботанський» характер вийшла з-під контролю

Alibaba відкриває у відкритому доступі модуль інтерпретованості Qwen-Scope для Qwen, який охоплює 7 моделей, станом на 30 квітня