Google กลับเข้าสู่การแข่งขัน AI แบบโอเพนซอร์สอีกครั้งด้วย Gemma 4

โดยสรุป

- Google ปล่อย Gemma 4 ซึ่งเป็นตระกูลโมเดลโอเพนภายใต้ใบอนุญาต Apache 2.0

- กลุ่มโมเดล 4 รุ่นครอบคลุมตั้งแต่โทรศัพท์ไปจนถึงดาต้าเซ็นเตอร์ โดยโมเดล 31B อยู่อันดับที่ 3 ทั่วโลกแล้ว

- AI โอเพนซอร์สของสหรัฐฯ ได้รับแรงส่งที่จำเป็น ขณะที่ Gemma 4 ซึ่งได้รับการสนับสนุนโดย DeepMind ตำแหน่งตัวเองเป็นตัวเต็งชาวอเมริกันที่แข็งแกร่งที่สุดในการสู้กับ DeepSeek, Qwen และผู้นำจีนรายอื่นๆ

ความทะเยอทะยานด้าน AI แบบโอเพนของ Google จริงจังขึ้นมากในวันนี้ บริษัทได้เปิดตัว Gemma 4 ซึ่งเป็นตระกูลโมเดลน้ำหนักแบบโอเพน 4 รุ่น สร้างจากงานวิจัยเดียวกับ Gemini 3 และได้รับอนุญาตภายใต้ Apache 2.0 ซึ่งเป็นการเปลี่ยนแปลงที่สำคัญจากเงื่อนไขที่เข้มงวดกว่าบน Gemma เวอร์ชันก่อนหน้า นักพัฒนามีการดาวน์โหลด Gemma รุ่นก่อนๆ มากกว่า 400 ล้านครั้ง ก่อให้เกิดเวอร์ชันที่ผู้คนในชุมชนสร้างขึ้นมากกว่า 100,000 แบบ การเปิดตัวครั้งนี้ถือเป็นความทะเยอทะยานที่สุดเท่าที่เคยมีมา

เราเพิ่งปล่อย Gemma 4 — โมเดลโอเพนที่ฉลาดที่สุดของเราเท่าที่เคยมีมา

สร้างจากงานวิจัยระดับโลกเดียวกับ Gemini 3, Gemma 4 นำความฉลาดที่ก้าวล้ำมาสู่ฮาร์ดแวร์ของคุณโดยตรง เพื่อการใช้เหตุผลขั้นสูงและเวิร์กโฟลว์เชิงเอเจนต์

ปล่อยภายใต้การอนุญาตเชิงพาณิชย์… pic.twitter.com/W6Tvj9CuHW

— Google (@Google) April 2, 2026

ตลอดปีที่ผ่านมา แผงจัดอันดับ AI โอเพนซอร์สส่วนใหญ่เป็นเรื่องของจีนเสียเป็นหลัก DeepSeek, Minimax, GLM และ Qwen ครองตำแหน่งหัวแถว ทำให้อีกฝั่งสหรัฐฯ ต้องดิ้นรนเพื่อความเกี่ยวข้อง เมื่อ Decrypt รายงานเมื่อปีที่แล้ว โมเดลโอเพนของจีนเพิ่มจากการแทบคิดเป็นเพียง 1.2% ของการใช้งานโมเดลโอเพนทั่วโลกในช่วงปลายปี 2024 มาเป็นราว 30% ภายในสิ้นปี 2025 โดย Qwen ของ Alibaba ยังแซง Llama ของ Meta ขึ้นเป็นโมเดลที่โฮสต์เองที่ถูกใช้งานมากที่สุดทั่วโลกอีกด้วย Llama ของ Meta เคยเป็นตัวเลือกเริ่มต้นสำหรับนักพัฒนาที่ต้องการโมเดลที่มีความสามารถและรันได้เฉพาะที่แบบโลคอล ชื่อเสียงนั้นเริ่มสึกกร่อนลง—ใบอนุญาตที่ Meta ควบคุมอยู่ทำให้เกิดคำถามเกี่ยวกับสถานะโอเพนซอร์สที่แท้จริง และประสิทธิภาพก็ถอยลงไปหลังการแข่งขันจากฝั่งจีน ครอบครัว OLMo ของ Allen Institute พยายามเติมเต็มช่องว่าง แต่ไม่สามารถสร้างแรงส่งที่มีนัยสำคัญได้ OpenAI เปิดตัวโมเดลตระกูล gpt-oss ในเดือนสิงหาคม 2025 ซึ่งทำให้อีโคซิสเต็มได้หายใจสะดวกขึ้น แต่ไม่เคยถูกออกแบบมาให้เป็นคู่แข่งระดับแนวหน้าที่แท้จริง และเมื่อวานนี้ สตาร์ทอัพในสหรัฐฯ ชื่อ Arcee AI ซึ่งมีทีม 30 คน ได้เปิดตัว Trinity โมเดลโอเพนพารามิเตอร์ 400 พันล้าน ซึ่งทำให้เห็นภาพชัดเจนว่าแถบอเมริกายังไม่ตายสนิท Gemma 4 สืบต่อโมเมนตัมนั้น ครั้งนี้โดยมีน้ำหนักเต็มของ Google DeepMind อยู่เบื้องหลัง ทำให้มันอาจกล่าวได้ว่าเป็นโมเดลอเมริกันที่ดีที่สุดในวงการ AI โอเพนซอร์ส “สร้างจากงานวิจัยและเทคโนโลยีระดับโลกเดียวกันกับ Gemini 3” Google กล่าวไว้ในการประกาศ โมเดล Gemma 4 มีให้เลือก 4 ขนาด: Effective 2B และ 4B สำหรับโทรศัพท์และอุปกรณ์เอดจ์, โมเดล 26B Mixture of Experts ที่เน้นความเร็ว และโมเดล 31B Dense ที่ปรับให้เหมาะกับคุณภาพดิบ

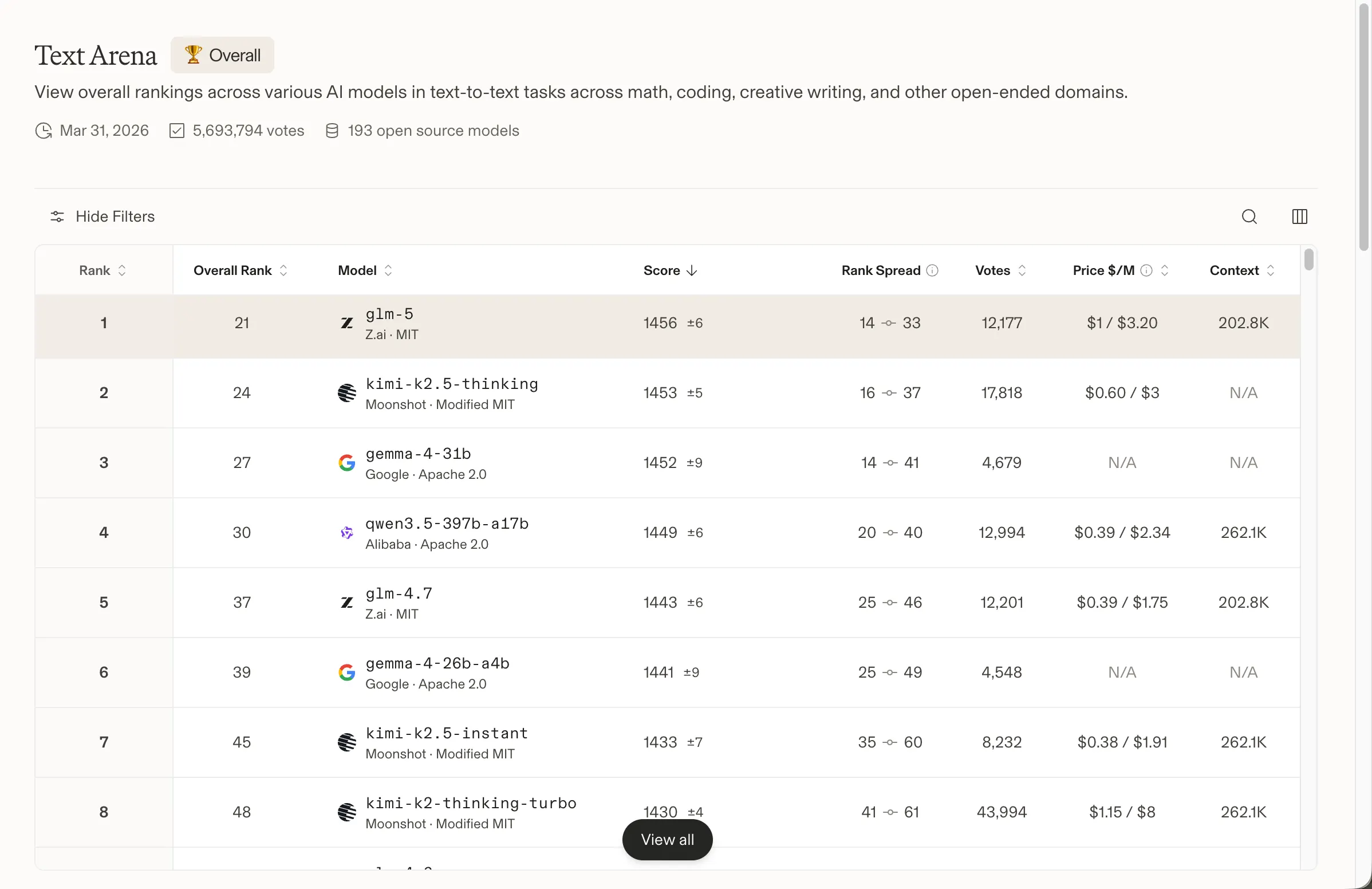

ตอนนี้ 31B Dense อยู่ในอันดับที่สามในบรรดาโมเดลโอเพนทั้งหมดบนลีดเดอร์บอร์ดข้อความของ Arena AI ส่วน 26B MoE อยู่ที่อันดับที่หก Google อ้างว่าโมเดลทั้งสองสามารถสู้ได้ดีกว่าโมเดลที่มีขนาดใหญ่กว่า 20 เท่า—ข้ออ้างนี้ยังพอใช้ได้ อย่างน้อยเมื่อเทียบกับตัวเลขของ Arena AI ซึ่งโมเดลของจีนยังคงครองสองอันดับแรกอยู่

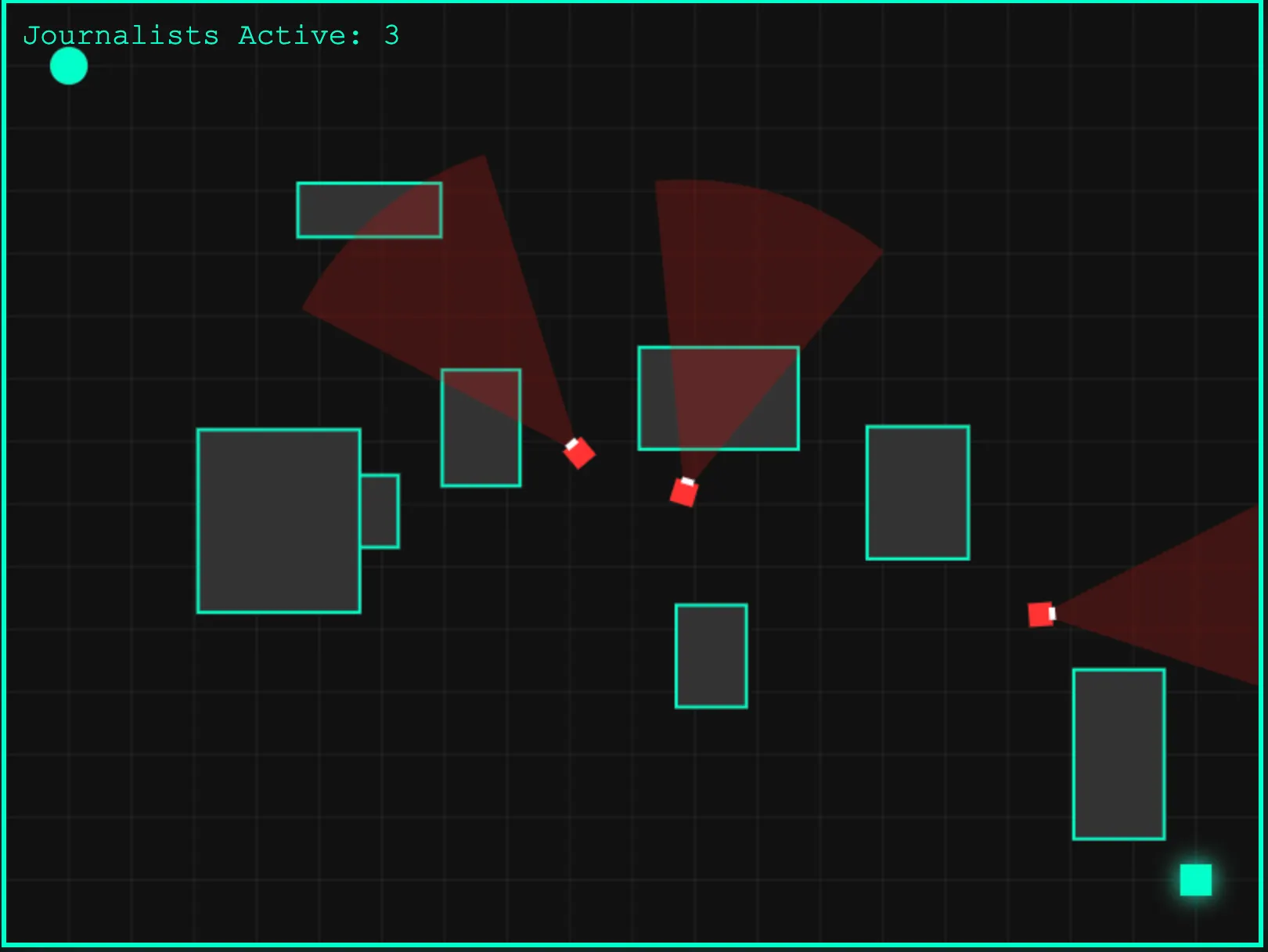

เราทดสอบ Gemma 4 แล้ว มันมีความสามารถ โดยมีข้อแม้บางประการ โมเดลใช้การให้เหตุผลแม้กับงานที่ไม่ได้ต้องการมัน ซึ่งอาจทำให้คำตอบดูเหมือนออกแบบมากเกินไปสำหรับพรอมพ์ที่เรียบง่าย การเขียนเชิงสร้างสรรค์ทำได้พอใช้—ไม่ถึงกับสร้างแรงบันดาลใจ และน่าจะดีขึ้นเมื่อมีคำแนะนำและการออกแบบพรอมพ์ที่เฉพาะเจาะจงมากขึ้น สิ่งที่มันทำได้ชัดที่สุดคือโค้ด เมื่อให้สร้างเกม ผลลัพธ์ไม่ได้ดูฉูดฉาดหรือซับซ้อนเป็นพิเศษ แต่ทำงานได้โดยไม่มีข้อผิดพลาดตั้งแต่ครั้งแรก ไม่เลวสำหรับโมเดลพารามิเตอร์ 41 พันล้าน ความน่าเชื่อถือแบบ zero-shot นี้อาจมีค่ามากกว่าผลลัพธ์ที่ดูสวยกว่า แต่ต้องมานั่งดีบัก คุณลองเกมได้ที่นี่ (พื้นฐานแต่ใช้งานได้)

โมเดลทั้งสี่ครอบคลุมสเปกฮาร์ดแวร์ได้ครบถ้วน รุ่น E2B และ E4B ถูกออกแบบมาสำหรับโทรศัพท์ Android, Raspberry Pi และอุปกรณ์เอดจ์ รันแบบออฟไลน์ทั้งหมดด้วยความหน่วงที่เกือบเป็นศูนย์ มีอินพุตเสียงแบบเนทีฟ และมีหน้าต่างบริบท 128K โมเดล 26B และ 31B มุ่งเป้าไปที่เวิร์กสเตชันและการปรับใช้งานบนคลาวด์ ขยายบริบทไปที่ 256K และเพิ่มการเรียกฟังก์ชันแบบเนทีฟพร้อมเอาต์พุต JSON แบบมีโครงสร้างสำหรับการสร้างเอเจนต์อัตโนมัติ ทั้งสี่โมเดลประมวลผลภาพและวิดีโอแบบเนทีฟ น้ำหนักแบบเต็มความเที่ยงของโมเดลที่ใหญ่กว่าจะพอดีบน GPU เดียว NVIDIA H100 ขนาด 80GB ส่วนเวอร์ชันที่ถูกทำให้เป็นควอนไทซ์จะรันได้บนฮาร์ดแวร์สำหรับผู้บริโภค ใบอนุญาต Apache 2.0 คืออีกประเด็นเด่น Google รุ่น Gemma ก่อนหน้านี้ใช้ใบอนุญาตแบบกำหนดเองที่สร้างความกำกวมทางกฎหมายสำหรับผลิตภัณฑ์เชิงพาณิชย์ Apache 2.0 ขจัดแรงเสียดทานนั้นออกไปทั้งหมด—นักพัฒนาสามารถปรับเปลี่ยน แจกจ่ายซ้ำ และทำเป็นผลิตภัณฑ์เชิงพาณิชย์ได้โดยไม่ต้องกังวลว่าต่อมาจะมีการเปลี่ยนแปลงเงื่อนไขโดย Google ผู้ร่วมก่อตั้ง Hugging Face อย่าง Clement Delangue ชื่นชมมัน โดยกล่าวว่า “Local AI กำลังมาถึงช่วงเวลาของมัน” และมันคืออนาคตของอุตสาหกรรม AI CEO ของ Google DeepMind อย่าง Demis Hassabis ไปไกลกว่านั้น โดยเรียก Gemma 4 ว่า “โมเดลโอเพนที่ดีที่สุดในโลกสำหรับขนาดของมันแต่ละแบบ”

ตื่นเต้นที่จะเปิดตัว Gemma 4: โมเดลโอเพนที่ดีที่สุดในโลกสำหรับขนาดของมันแต่ละแบบ มีให้เลือก 4 ขนาดที่สามารถปรับแต่งให้เข้ากับงานเฉพาะของคุณ: 31B dense สำหรับสมรรถนะดิบที่ยอดเยี่ยม, 26B MoE สำหรับความหน่วงต่ำ และ effective 2B & 4B สำหรับการใช้งานบนอุปกรณ์เอดจ์—ขอให้สนุกกับการสร้างเลย! pic.twitter.com/Sjbe3ph8xr

— Demis Hassabis (@demishassabis) April 2, 2026

นี่คือข้อกล่าวอ้างที่หนักแน่น ระบบที่เป็นกรรมสิทธิ์ของ Anthropic, OpenAI และ Gemini ของ Google เรายังคงนำอยู่ในการทดสอบที่ยากที่สุด แต่สำหรับโมเดลน้ำหนักแบบโอเพนที่คุณรันได้โลคอล ปรับแต่งได้อย่างอิสระ และนำไปใช้งานบนโครงสร้างพื้นฐานของคุณเอง? การแข่งขันก็เพิ่งทินลงไปมาก คุณลอง Gemma 4 ได้ตอนนี้ใน Google AI Studio (31B และ 26B) หรือ Google AI Edge Gallery (E2B และ E4B) น้ำหนักโมเดลยังมีให้ที่ Hugging Face, Kaggle และ Ollama ด้วยเช่นกัน